腾讯优图13篇论文入选ICCV2019,涉及2D图像多视图生成等研究

允中 发自 凹非寺

量子位 报道 | 公众号 QbitAI

两年一度AI顶会ICCV已经召开,今年在韩国首尔举办。

随着论文收录名单揭晓,大会也进入放榜收获时刻。

腾讯旗下顶级视觉研发平台腾讯优图,官宣有13篇论文入选,居业界实验室前列,其中3篇被选做口头报告(Oral),该类论文占总投稿数的4.3%(200/4323)。

ICCV——国际计算机视觉大会,英文全称International Conference on Computer Vision。

被誉为计算机视觉领域三大顶级会议之一,与CVPR和ECCV并列,录用率非常低,其论文集代表了计算机视觉领域最新的发展方向和水平。

本届ICCV共收到4323篇论文投稿,其中1075篇被录用,录取率25%。

而优图入围的13篇论文中,涉及2D图像多视图生成、人脸照片的图像转换等喜闻乐见研究。

我们选取其中代表性的2篇初步解析,2篇均有贾佳亚教授参与,详细论文见传送门。

2篇论文

基于视角无关特征的多视图对抗生成框架

View Independent Generative Adversarial Network for Novel View Synthesis

本论文与香港中文大学合作完成,论文入选Oral。

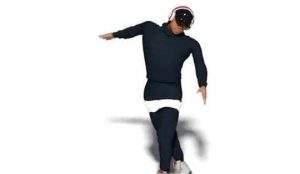

2D图像的多视图生成任务,指的是基于单张2D图像,生成其不同视角下的图像信息。

此类方法可以在不涉及复杂的三维重建的基础上,实现多个视角下的信息的合成观察。

例如下图中给定特定视角的2D图像,可以生成其他各个视角的图像信息:

该论文提出了一种适用于此类任务的对抗生成框架,旨在通过结合图像对应的相机参数信息,实现对于多类物体均适用的多视角转换框架。

长远来看,这项技术的应用有望让普通的2D视频也能实现3D观感,就像在电影院观看的3D电影一样。

现有的多视图生成任务中,当前基于生成模型的方法将预先提取输入图像中与视角信息无关的特征,而后将视角信息相关的参数作用于此特征,进而得到生成的结果。

该论文中,作者使用此种思路,配合以多种损失函数的设置,利用相机参数加上图像信息来得到与视角无关的特征。

相比于现有的方法,该方法适用于连续相机参数下的多视图生成,并不限制于数个固定的视角。

除了合成视图与监督信息之间的损失函数之外,本文提出使用一种基于循环生成的重建损失函数,来提升合成视图的准确性;同时借鉴目前的对抗生成技术,从图像本身的生成分布,与图像的姿态准确性保证两方面出发,提出两个不同作用的对抗学习损失,以提升生成图像的质量和合成视图的姿态准确度。

该框架可以适用于不同类别的物体。

首先是人脸在预先设定的有限数目的视角之间的转换结果。最左边是输入的2D图像,箭头右侧均为生成的,不同视角下的结果。

应对其他一般的物体。通过在Shape-Net这个数据集上的多个类别物体作为数据,得到以下结果:

通过在多个类别的物体上进行多视图生成任务,利用多个定量定性指标来进行评价,证明该方法具有通用性,且在多个类别任务上表现良好。

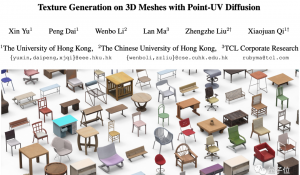

基于属性自光流域的非监督图像转换算法

Attribute-Driven Spontaneous Motion in Unpaired Image Translation

△微笑表情转换结果图。从左到右依次为:输入、StarGAN结果、该论文结果

本论文与香港中文大学、哈工大深圳研究院合作完成。

人脸照片随着社交软件的普及被大幅度地应用于各种社交应用中,而人脸照片的自动化编辑一方面作为社交软件的娱乐应用促进了社交用户的交流,另一方面也帮助用户对人脸照片进行快速的自动化编辑。

由于深度学习的兴起,基于深度神经网络的图像转换(Image translation)技术常常被应用于图像编辑任务上。

现有的图像变换算法主要基于生成对抗神经网络,这些算法尽管能生成较高分辨率的图像,但由于它们较少考虑图像之间的几何变形关系,转换后的图像往往包含许多瑕疵和失真,尤其是在原图像域和目标图像域几何结构不一致的情况下。

本论文提出了SPM(自光流模块),希望通过学习不同图像域间的光流解决图像的几何变换问题。

其框架以传统的生成器-判别器作为基础,其中,生成器用于生成更好的图像,而判别器用于判别生成器生成图像的质量好坏。

此外,他们在生成器的基础网络结构上做出扩展以适应图像转换之中的几何变换。

扩展后的生成器包含两个主要模块,自光流模块SPM和微调模块R。

最后,该论文还引入了从低分辨率图像到高分辨率的生成方案。

△整体框架图

本文提出的自光流模块,通过输入原图像和目标属性,自光流域模块旨在预测光流,并利用光流对原图像采用变形操作得到中间结果图像。

该论文利用一个编码-解码网络作为该模块的主要结构,其中他们主要考虑了网络结构、域分类器、微调模块、残差结构、注意力掩码几方面的设计。

同时,为了产生更高分辨率的图像,该论文采用了一种新颖的粗到细的神经网络训练策略。

在训练好低分辨的神经网络后会有许多中间结果的低分辨率表示。

具体地,低分辨率的自光流域w残差r以及注意力掩码m是已知的。为了得到它们的高分辨率表示,首先对它们进行双线性插值上采样到分辨率更高的w, r以及m。

但是通过双线性插值的上采样所得到的结果往往是模糊的,因此对于这三个变量他们引入了三个小的增强神经网络对上采样的结果进行微调。

利用微调后的高分辨率中间结果,我们即可对高分辨率的输入图像进行处理和转换,并最后得到相应的高分辨转换结果。

如图所示,RaFD数据集上的图像转换结果,从左到右依次为:输入、愤怒、惊恐、开心(后三个为算法生成结果)。

本论文通过提出自光流模块,将图像域间的几何变换显式地引入到了图像转换框架中。算法主要在CelebA-HQ和RaFD数据集上进行验证,其结果相比于现有算法都有一定的提升。

其各部分的实验充分证明了该框架的有效性,并且取得了很好的图像转换效果。

这一框架也给解决图像转换中的几何变换问题提供了新的解决思路。

传送门:

基于视角无关特征的多视图对抗生成框架

http://jiaya.me/papers/vigan_iccv19.pdf

基于属性自光流域的非监督图像转换算法

https://arxiv.org/abs/1907.01452

- 腾讯开源手机端离线翻译模型,仅0.4G,支持33种语言2026-04-29

- 腾讯官宣升级AI小程序成长计划,所有小程序都能申请2026-04-16

- 25.98万元起!智己LS8震撼开启预售,30万内享百万级跨代际体验2026-03-28

- 上海凭什么敢自封“开发者之城”?看完这场大会议程我悟了2026-03-22