2张图就可生成一段逼真视频,来自Stable Diffusion技术团队

逼真丝滑,跟实拍一样。

詹士 发自 凹非寺

量子位 | 公众号 QbitAI

新魔法!效果炸!

两张静态图片,几秒即生成视频,丝滑如实拍!

举例来说,两张狗子照片,就能让它慢慢抬起头,连身体也随之伸展:

还是两张照片,一键生成。

小女孩跳起,双手自然交叉,衣服轻轻摆动,与实拍别无二致:

这些视频由一个帧插值工具根据图片生成,人人都能在线免费玩(链接见文末)。

这两天刚公布就在网上引发不小关注,推特上like超过2500。

评论区里,网友一片喜大普奔。

有人感到大受震撼,鹅妹子嘤:

还有人表示,这是什么现代巫术:

当然,还有更多网友迫不及待想试试。

它究竟什么个来路?往下看。

Frame Interpolation试玩

先看看试玩效果。

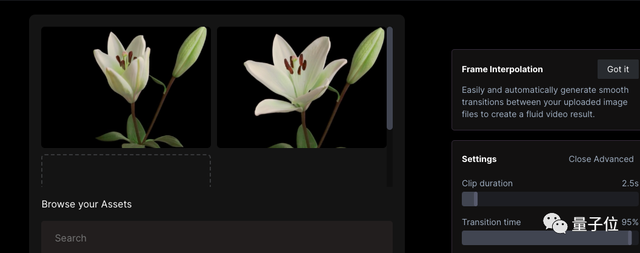

登陆web端口,上传两张开花图片:

设定好视频时长,比如2秒,就能得到这一段视频,花朵慢慢打开,镜头也逐渐拉近:

再试试两张狗子照片,让它转个头:

不过,上传两张鸟在天空不同位置飞的照片,效果就不ok了:

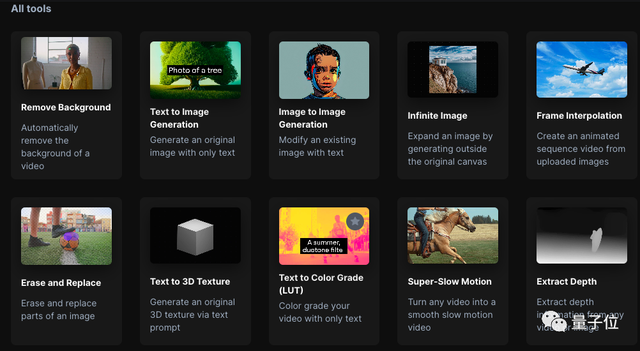

前文提及,该产品是一种帧插值(Frame Interpolation)工具。

所谓帧插值,即在视频两个帧之间,插入一部分新的合成帧,相关技术被广泛应用于图片生成视频、视频流中的帧修复。

谷歌今年有篇《大幅动作的帧插值》(About FILM: Frame Interpolation for Large Motion)已被ECCV 2022接收。

技术人员通过双向运动估计、与尺度无关的特征提取等方式,做出了较好的帧插值效果。

就目前来说,该技术难以突破的点在于:

即便是短短几秒,图片中人物或物体也进行了一套复杂动作,使得帧插值后,视频失真。

不过,如果不追求写实,做出一些魔幻效果,该技术已经绰绰有余(手动狗头):

△ 比如让建筑变成变形金刚

背后团队与Stable Diffusion有渊源

此番大火的帧插值工具背后团队叫:Runway。

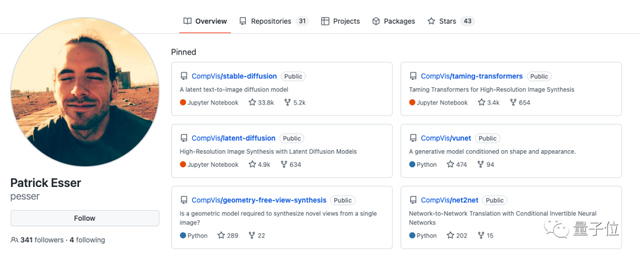

最近AIGC圈顶流,Stable Diffusion,所依据的论文《High-Resolution Image Synthesis with Latent Diffusion Models》正是由慕尼黑大学、海德堡大学及他们共同完成。

其中作者之一的Patrick Esser,也是Runway的首席科学家。

(值得一提的是,Patrick Esser及Runway前段时间还在与Stability AI因Stable Diffusion来回扯皮。)

根据公开资料,Runway成立于2018年,是一家希望用AI/ML与计算机图形学技术在视频、图像、音乐、文本领域提供内容创意工具的创业公司,总部位于美国纽约。

截至目前,该公司已总计获得4550万美元投资,投资方包括Coatue、Amplify、Lux、Compound等机构。

Runway旗下产品涉及多个模态,不仅有开头提及的静态图片生成丝滑视频,也包括文本生成图像、图片移除背景、依靠文本对图像修改、删除视频中物体、声音去噪等等。

感兴趣的朋友,可在他们的官网试玩。

附上链接:https://app.runwayml.com/video-tools

参考链接:

[1]https://weibo.com/tv/show/1034:4833638056132718?from=old_pc_videoshow

[2]https://app.runwayml.com/ai-tools/frame-interpolation

[3]https://twitter.com/runwayml/status/1587791749912662022

[4]https://github.com/runwayml/guided-inpainting

[5]https://arxiv.org/abs/2205.09731

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态

- 大数据已死!从业10年老哥爆文抨击:这套唬不住客户了2023-02-14

- ChatGPT五分钟写完插件,功能完善,还可加需求改BUG2023-02-09

- 谷歌创始人亲自下场改代码,ChatGPT让谷歌真慌了2023-02-03

- 谷歌加紧测试ChatGPT竞品,靠对话可搜最新信息2023-02-02