国产GPTs来了,基于智谱第4代大模型!模型性能均达GPT-4九成以上

新能力全量上线

衡宇 发自 凹非寺

量子位 | 公众号 QbitAI

国产大模型玩家智谱AI,交出最新成绩单——

发布全自研第四代基座大模型GLM-4,且所有更新迭代的能力全量上线。

作为国内唯一一个产品线全对标OpenAI的大模型公司,智谱年前攒了波大的:

按官方说法,GLM-4性能相比GLM-3提升60%,逼近GPT-4(11月6日最新版本效果)。

而同时推出的GLM-4-All Tools,能够完成用户意图理解-复杂指令规划-自由调用GLM生态的多种模型能力。

值得一提的是,智谱发布了GLMs,为所有开发者提供AI智能体定制能力,简单prompt指令就能创建个性化GLM智能体。

之前,智谱CEO张鹏就明确过:

OpenAI摸着石头过河,我们摸着OpenAI过河。

摸来摸去摸了一年,以每3-4个月升级一次基座模型的速度,智谱摸着OpenAI过河的最新成绩到底怎么样?真如所说吗?

当官方用上“可对比”“对标”“追平”等字眼后,智谱接下来的路又会怎么走?

好奇,感兴趣,想知道。

(我猜你们也是)。

所以,发布GLM-4的智谱AI技术开放日现场,我们替没到场的小伙伴听了、看了;满肚子的问题,我们也帮大家抓住张鹏问了。

GO——

“摸着OpenAI”,路走成什么样了?

智谱为什么敢喊出“逼近”甚至部分超过GPT-4?

老规矩,直接一起看GLM-4的现场演示:

首先来看整体性能。

基础能力方面,张鹏在现场介绍了GLM-4在各项评测集上的最终得分。

- MMLU:81.5,达到GPT-4的94%水平;

- GSM8K:87.6 ,达到GPT-4的95%水平;

- MATH :47.9,达到GPT-4的91%水平;

- BBH :82.3,达到GPT-4的99%水平;

- HellaSwag :85.4,达到GPT-4 的90%水平;

- HumanEval:72,达到GPT-4的100%水平。

指令跟随能力方面,和GPT-4相比,IFEval在Prompt提示词跟随(中文)方面达到88%,指令跟随(中文)方面达到 90%水平,超过GPT-3.5。

对齐能力上,基于AlignBench数据集,GLM-4超过了GPT-4的6月13日版本,逼近GPT-4最新(11月6日版本)效果。

在专业能力、中文理解、角色扮演方面,GLM-4超过GPT-4精度。

不过张鹏也表示,GLM-4在中文推理方面的能力,还有待进一步提升。

其次,在大模型的“内存”能力方面,GLM-4系列支持128k上下文窗口长度,单次提示词可处理文本300页,比前作有所提升。

在needle test大海捞针测试中,GLM-4在128K文本长度内均可做到几乎百分之百精度召回。

除此之外,GLM-4系列集成了一些新能力在身上,主要是Agent能力和多模态能力。

多模态能力方面,GLM-4则是把原本就有的文生图(CogView3)、代码能力做了升级。

智谱强调,CogView3效果超过开源最佳的Stable Diffusion XL,逼近DALLE·3。

至于Agent能力方面,此前智谱发布过AgentLM系列并开源。

这次是把Agent能力整合进了GLM-4,有了GLM-4-All Tools。

它可以根据用户意图,自动理解、规划复杂指令,自由调用文生图、代码解释器、网页浏览能力,以完成复杂任务。

对GLM-4的发布,综合下来给人一种这样的感觉:

去年10月底第3代基座大模型,该公司在模型产品线上和OpenAI逐一对齐;第4代是在拉齐模型能力和OpenAI GPT-4的能力水平线。

明显能感觉到,智谱的基座模型越往后升级,越开始不强调模型参数大小,转而开始尽可能地向外界展示可用能力。

为什么不想强调参数规模了?会像OpenAI一样逐渐close起来吗?

量子位打听了一番,听到的消息是,现在的技术主流路线已经发现并不是参数量越大越好——当然,模型越“大”,肯定能带来能力涌现的好处,但模型越大,成本就越高,成本高自然不是市场想要追求的。

同时,现在的技术演进和发展已经表明,追求更好的能力,可以用一些更精细的方法,在保证模型无需十倍级提升参数的情况下,大幅提升性能。

以上两个原因相加,是智谱也不再强调基座模型参数的背后原因。

参数不强调了,外界的目光自然更加紧盯这一代基座模型的性能——这确实是智谱这回想要强调的东西。

接下来将主要发力三个方向

“大模型的技术,不是说把原来系统里的小模型扔掉,换上大模型的接口就行了。这只是在局部做了替换,本质上并无改变。”张鹏解释道,“但我们大家潜意识里期待的,是完全的革新和创新,是不需要原来的那套结构。”

他补充解释,从新技术出发,改造整个生产流程、提升生产效率和生产力,这就是拥有大模型能力后,“AI原生”会完成的任务。“那AI原生的应用前提条件是什么?还是得回到模型本身的能力。”

张鹏表示,模型能力足够强、维度足够多、能力要能融合产生化学反应从而扩大能力空间,本质上还是看模型能力的事儿。

我们想得很清楚,还是要做好我们最擅长、最喜欢的事情,然后大家一起来做这个生态。

为了把GLM的生态圈建起来、建好,摸着OpenAI过河的智谱,这会推出了可定制化的GLM。

也就是GLMs。

无论任何用户,只要用简单的prompt指令,就能创建属于自己的GLM个性化智能体。

张鹏还在现场宣布,智谱智能体中心也同时上线。

等等……既然GLMs有了,GLM Store是不是也不远了?!

好问题。量子位当然第一时间拿这个问题问了张鹏。

得到的答案是:

紧接着,我们锲而不舍地抛出了新的问题:

如果说之前的行为都是在摸着OpenAI过河,那么现在,智谱的基座模型喊出对标GPT-4,接下来的路会怎么走?

张鹏稍稍透露了那么一点,主要是在三个方向发力。

- 超级智能

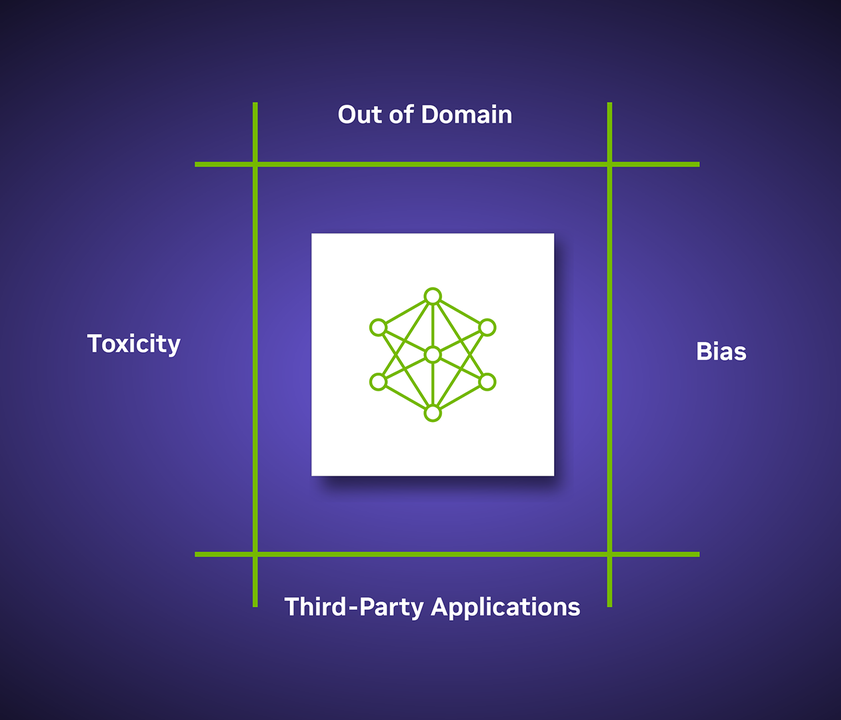

- 超级对齐

- 具身智能

其中比较值得拿出来说道说道的,是“超级对齐”这一点。

这里回顾一下有关超级对齐的前情提要:去年7月,OpenAI首次提出超级对齐这一概念,宣布成了一个新的研究团队,在未来4年投入20%算力,用AI监督AI的方式,解决超级智能AI与人类意图对齐的问题。

“我个人觉得,在(超级对齐)这件事情上,可能我们认知还没有那么深,或者说大家对这事情的认知不太一致。”张鹏说。

在他看来,OpenAI创始人之一Ilya想做到的超级对齐,是想要在AI从诞生之时起,就从底层保持着对人类最大限度的爱,“他是要去探寻本源。自训练、自学习这样的能力实际上是对世界知识的一种压缩和表示,所以实现这个目标,需要从知识或数据层面来解决。”

简单来说,Ilya有关超级对齐的研究,可以等价为尝试开黑盒,然后设法从AI智能产生的那一刻起,就和人类意图对齐。

而张鹏表示,他个人在现阶段更倾向于另一派的观点,即从行为主义角度出发。

“超级对齐究竟是什么?想要对齐一个东西,这东西都还不存在,咋对齐?对齐啥呢?”

从行为学角度考虑,就不用考虑开黑盒的问题,研究者只需要像教育孩子一样,先观察小孩的行为。看到AI行为是错的,就给一巴掌;行为是对的,就给一颗糖。

想要成为“AGI元年”,2024需要面对什么?

2024年,短短半个月期间,GPT上线了GPT Store,智谱推出了GLM-4……

而这一年才刚刚开始。

热闹非凡的百模大战打了一年,有的玩家已经偃旗息鼓了,但可以肯定,OpenAI会带领GPT继续迭代,智谱或许也会继续以3-4月更新一次基座模型的速度向前推进,国外的Anthropic、Mistral AI、Google,国内的零一万物、MiniMax等都会如此。

那么,如果按照业界默认,称刚刚过去的2023年为大模型元年的话,2024想要“化身”AGI元年,正面临哪些挑战?

去年3月,在量子位举办的AIGC峰会上,张鹏认为外界环境带来的三大挑战是人力、成本和算法。

当现在把这个问题丢到张鹏面前时,他的看法是,加入到大模型研究中的人已经极大丰富了,困境有所缓解;取代它位列新三大困境之一的则是“环境”。

一方面,挑战者能不能有足够的敏锐度,从环境中寻找并掌握突破口?

张鹏用他前段时间在某群里刷到的一个视频作为形象的例子,那个视频展示的是许多人小时候玩儿过的小球消砖块游戏。

最佳情况是把球从正好的角度打进砖块包围的缺口,然后形成数次拐弯,消灭掉所有的砖块。

实际上这个机率很小,很多次都会和“正好”的角度擦肩而过;或者看似瞄准了缺口,又不幸地被挡住弹了回来。

终于有一天,你打进了缺口,然后什么都不用干,自然而然所有的砖块都被消除了。

另一方面,在不断试错、不断失败的过程中,市场乃至整个社会对技术的耐心能够持续多长时间?

如果市场失去耐心,大模型这样一个消耗很大资源要做的事,立刻会陷入玩不下去的窘境。

然而玩弹球砖块游戏,很多人并不能坚持到砖块全部消除。

“前面的试错、铺垫是难以忍受的。就像面对科技创新,大家期待的都是最后的爆发时刻。”

- 消费级显卡可以快速上手跑!面壁智能MiniCPM-o 4.5发技术报告2026-04-28

- 大厂AI抢人大战,从实习生开始2026-04-22

- Kimi新论文:把KVCache玩成新商业模式了2026-04-19

- 20亿美金苏度科技具身首秀即大招!0真机数据,zero-shot,跑出98%首次抓取成功率2026-04-20