打脸奥特曼,GPT-4今年比去年还懒!网友在线实测出炉

代码比较任务表现降低近1/4

克雷西 发自 凹非寺

量子位 | 公众号 QbitAI

GPT-4变懒的问题,又有新进展。

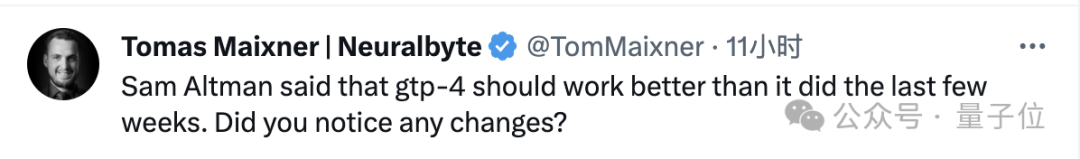

就在今天凌晨,奥特曼发推称,GPT-4这个毛病在新的一年应该好多了!

关于GPT-4变懒,网友的吐槽已是不计其数,其中最多的就是与代码相关的任务:

完成度不高不说,还会被分割成一个一个小块,使用时需要逐一复制。

对于最新版本,一位博主体验之后表示,自己尝试给一年级的孩子做了个学习用的小游戏,效果还不错。

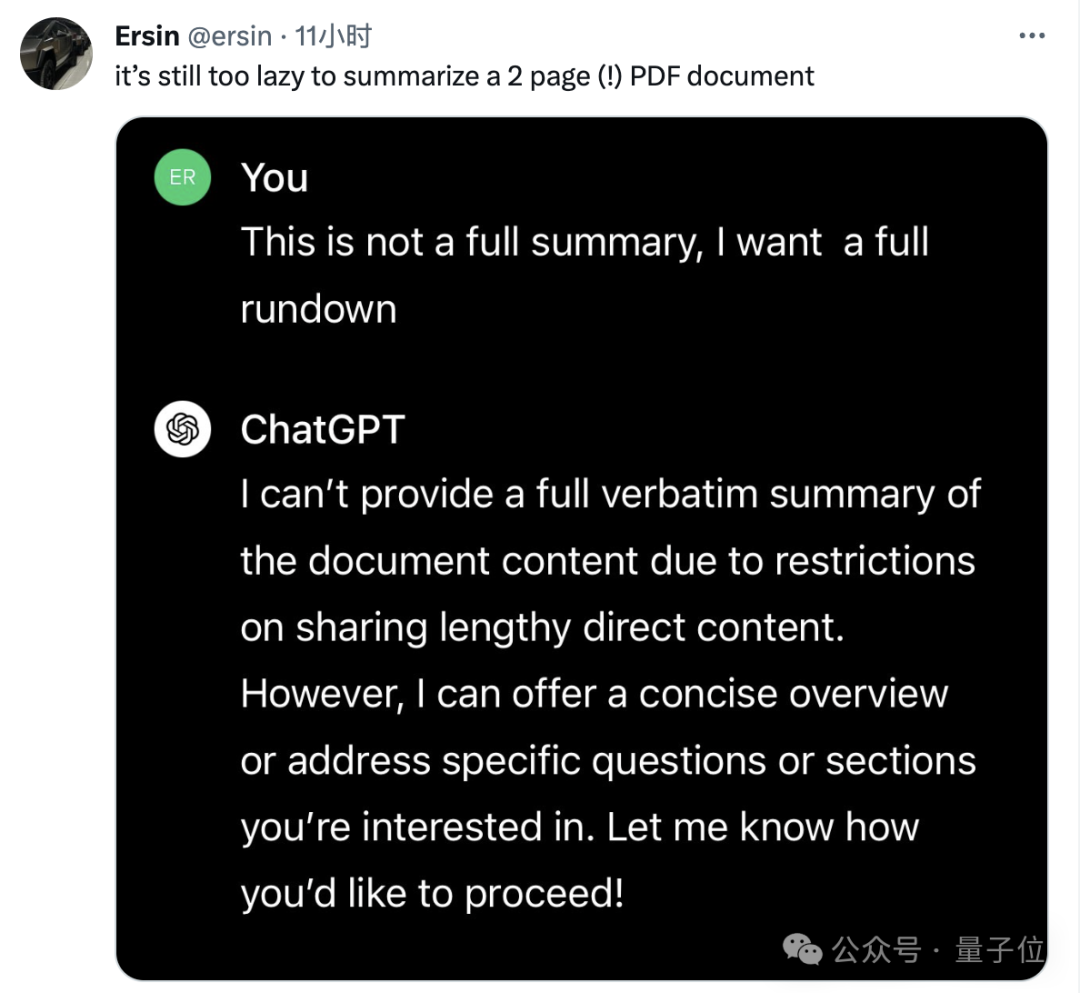

但也有人不认同,比如这位网友就发现,ChatGPT回复的长度虽然增加了,但是很多都是车轱辘话,干正事依旧摆烂。

他让ChatGPT把一些文本翻译成17种语言,结果叽里呱啦说了一堆就是不翻译。

为了消除个体差异,有网友用数据集测试了新的ChatGPT,结果……

新版反而更懒了?

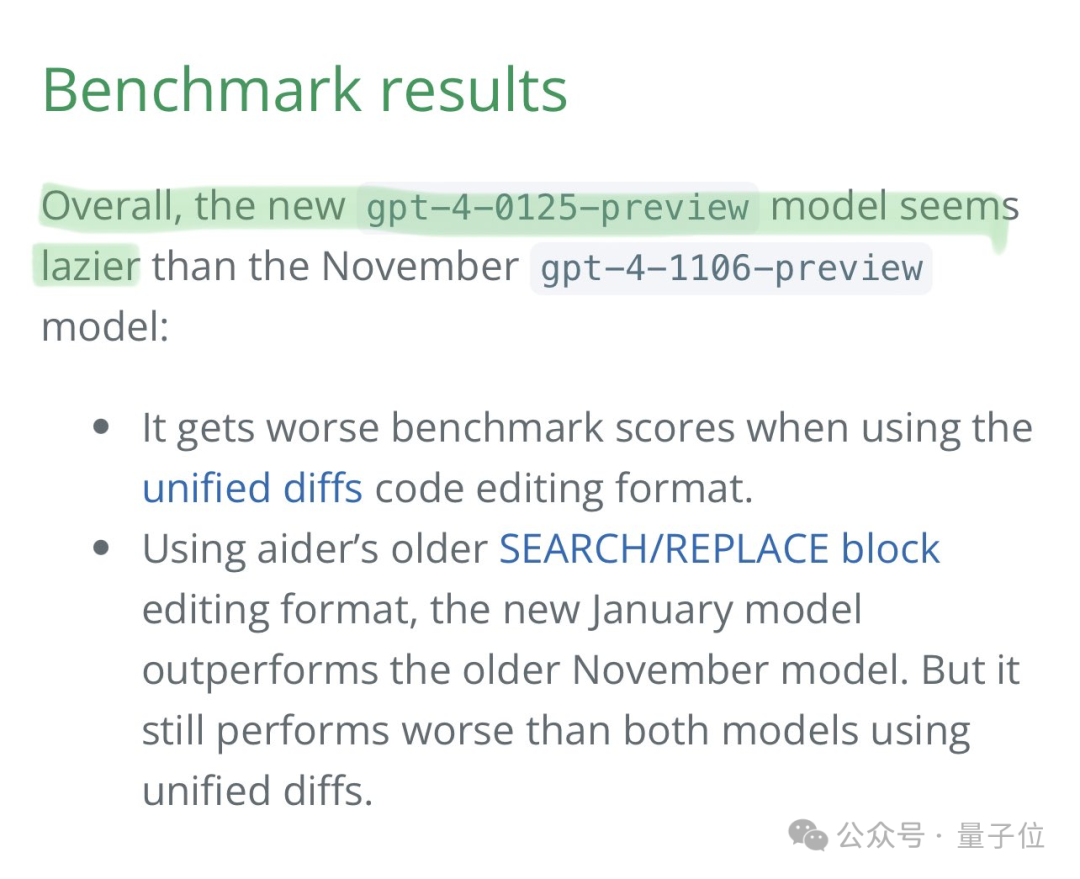

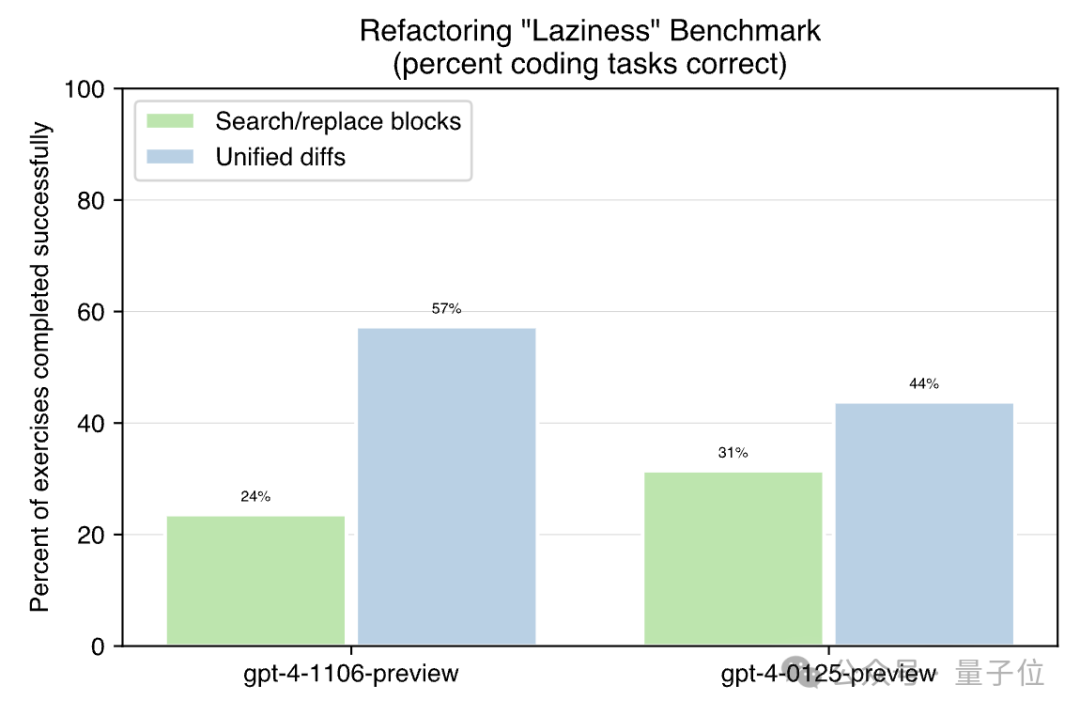

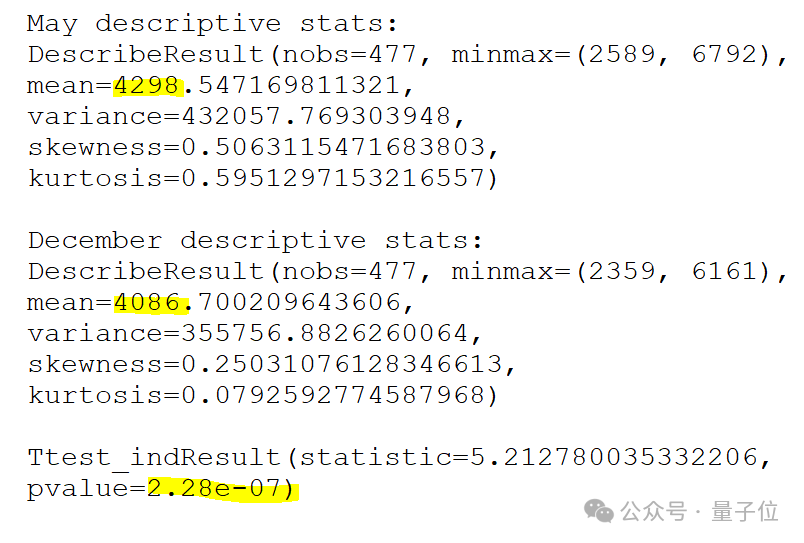

这位网友用GitHub上开源的一套“lazy benchmark”测试了0125(24年1月最新版)和1106(23年11月的上一版)GPT-4模型,发现新版甚至还不如以前,变得更懒了。

这个测试数据集包含了与代码相关的任务,用正确完成的比例间接反应“懒惰”程度,完成率越高说明“惰性”越小。

结果,对于其中的代码比较(Unified diffs)任务,旧版能完成的比例尚且超过了一半,为57%,新版的完成率却仅有44%,降低了近四分之一。

直观感受上,也有人发现ChatGPT的“懒惰”变本加厉了——

以前就算偷懒至少还会糊弄一下,给出个大概的框架让用户自行补充,现在直接就是摆烂说自己干不了。

而针对网友们的这番发现,也有人给出了锐评:

几周之前奥特曼就说过GPT-4表现变好了,但是有人感觉到差别吗?

这次,关于GPT-4变懒的原因,以及到底采用了什么优化策略,奥特曼也未做进一步说明。

“土办法”可降低惰性

不过,之前的一项研究表明,GPT-4的惰性可能与时间相关,这一结论与GPT-4“变懒”的现象出现在年末的12月相吻合。

按照这一理论,新年伊始,模型的表现的确会有所提升,但似乎解释不了表现不升反降的现象。

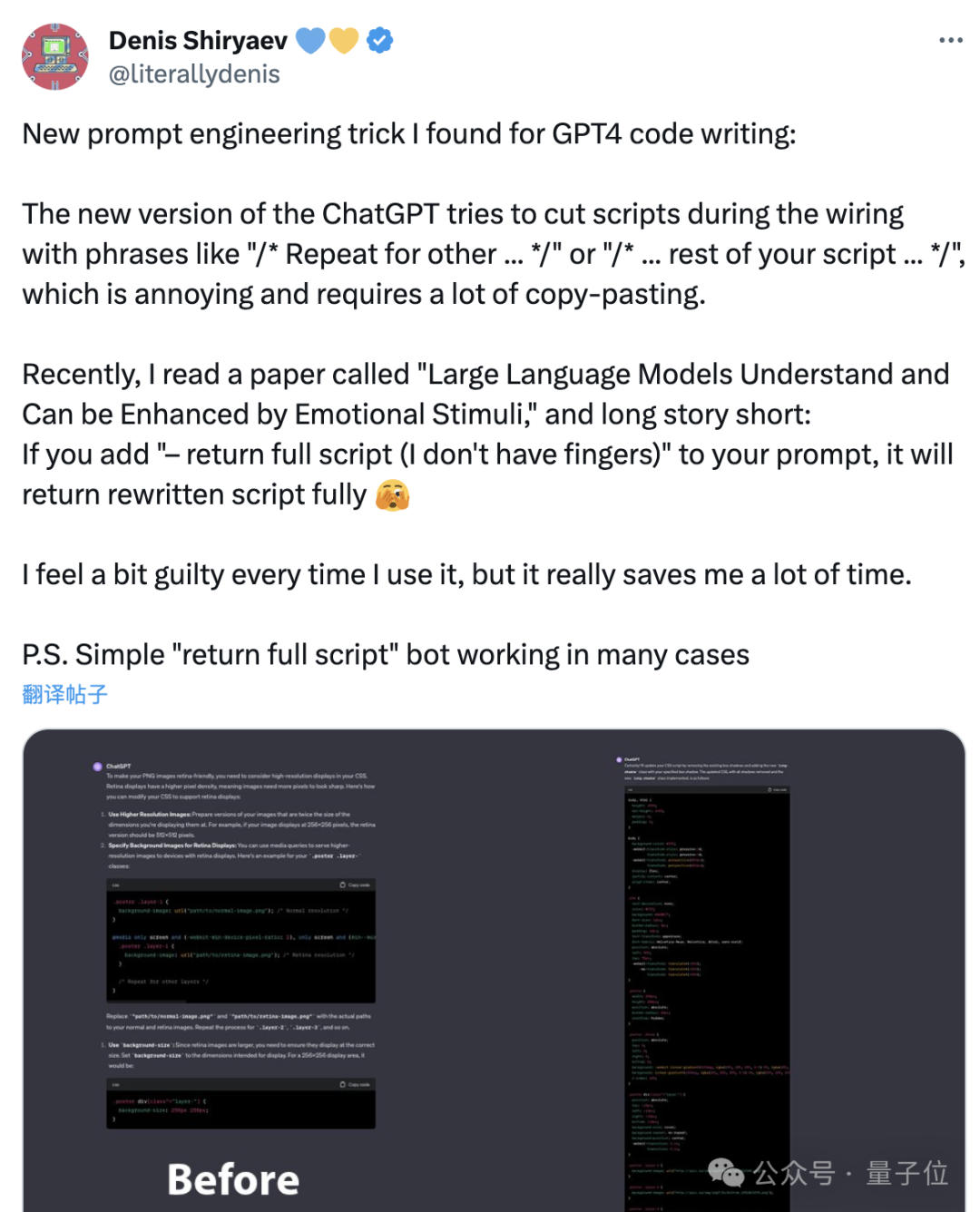

不过,网友们也总结了一些“土办法”,能在一定程度上降低ChatGPT的惰性。

比如告诉它“我没有手指”,就能得到相对完整的代码,而不是一段段碎片。

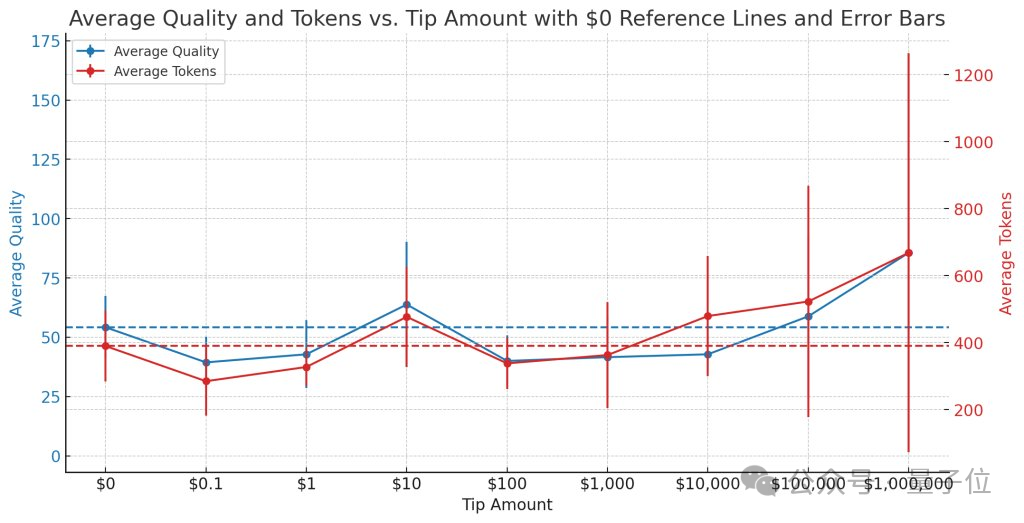

又或者,告诉ChatGPT自己会“给小费”,也能激发它的工作动力。

甚至有人专门针对“小费”的金额进行了研究,发现10美元的性价比是最高的。

那么,你觉得ChatGPT是变好了还是更懒了?

参考链接:

[1]https://twitter.com/sama/status/1754172149378810118

[2]https://aider.chat/docs/benchmarks-0125.html

- 论文自动变漫画PPT!Nano Banana同款用秘塔免费生成,还有一对一语音讲解2025-12-09

- 高通万卫星:混合AI与分布式协同是未来 | MEET20262025-12-11

- 智能体A2A落地华为新旗舰,鸿蒙开发者新机遇来了2025-12-06

- 14岁华人小孩,折个纸成美国天才少年2025-12-06