何恺明组三位本科生领衔!持续聚焦Flow模型,突破归一化流生成效率瓶颈

速度提升两个数量级

鱼羊 发自 凹非寺

量子位 | 公众号 QbitAI

何恺明团队新作,持续聚焦Flow模型。

与MeanFlow对流匹配的优化不同,这次主要旨在解决归一化流在生成模型中的局限。

论文提出名为双向归一化流(BiFlow)的新框架,通过解耦前向过程——将数据映射为噪声,和逆向过程——把噪声再转回来生成图片,成功打破了传统归一化流生成模型效率低下的问题。

值得一提的是,论文的三位一作分别是来自清华姚班和MIT的本科生。

BiFlow:逆向过程不必是前向过程的精确逆运算

归一化流方法(NFs)已经成为生成建模的一种原则性框架。

标准的归一化流包含前向过程和逆向过程:

前向过程将数据映射为噪声,逆向过程则通过对前向过程求逆来生成样本。

传统的NF模型有一个硬性规定,逆向过程必须是前向过程的精确逆运算——要像钥匙和锁一样完全匹配。这就导致了两个问题:

- 模型设计受限:因为要保证 “可逆”,不能使用很多强大的通用架构(比如视觉Transformer),得特意设计复杂结构;

- 推理速度慢:由于架构约束,归一化流通常需要比其他模型更深、更宽的网络才能达到相似效果。以TARFlow为例,逆向生成时需要一步步按顺序计算,并且无法并行加速。

BiFlow的核心创新就在于,打破了“逆向过程必须是前向过程的精确逆运算”这一规则。

设计思路是这样的:

BiFLow解耦了前向过程和逆向过程的设计。

前向模型仍然使用易于训练的流模型(如改进版TARFlow),将数据映射为噪声。

逆向模型则引入一个可学习的独立模型,来近似前向模型的逆映射。

由此,逆向模型不需要是前向模型的数学精确逆,可以使用任意架构(如非因果的双向Transformer)来实现并行化和高效计算。

逆向模型也可以在单次前向传递中,直接从噪声生成图像,无需像自回归模型那样逐步生成。

具体来说,何恺明团队的这篇新论文提出了三项关键技术。

隐藏层对齐(Hidden Alignment)

为了解决独立逆向模型容易跑偏的问题,论文提出了一种新的损失函数策略,既利用了全轨迹监督,又保持了架构的灵活性:

- 利用前向过程的完整中间状态轨迹(数据→半噪声→纯噪声)作为监督信号;

- 通过可学习的投影头,将逆向模型的中间状态与前向状态对齐。

学习去噪(Learned Denoising)

传统NF方法(如TARFlow)推理时需要额外去噪,会增加计算量。

BiFlow将去噪步骤直接整合进逆向模型的一个额外模块中,实现了“端到端”的从噪声到清晰数据的映射,消除了额外的推理开销。

训练时无分类器引导(Training-time CFG)

为了在推理时保持单步生成(1-NFE)的高效性,BiFlow在训练阶段就引入了无分类器引导(CFG),让模型学习以CFG比例为条件的生成,从而避免了推理时计算两次前向传播的成本。

实验结果:速度提升两个数量级

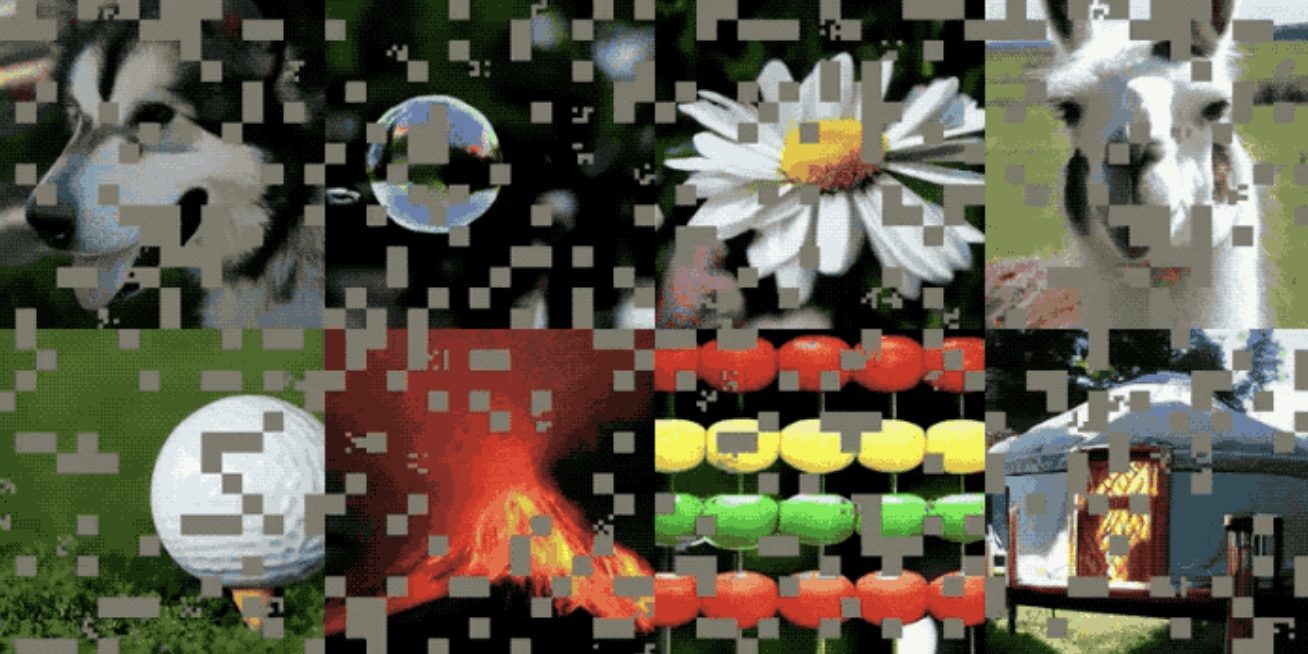

实验结果显示,在生成质量方面,BiFlow在ImageNet 256×256数据集上,取得了2.39的FID分数,刷新目前基于NF方法的SOTA。

在推理速度方面,相比于基线方法(改进版TARFlow),BiFlow的采样速度提升了两个数量级(在TPU上快697倍)。

另外,BiFlow凭借双向映射特性,无需额外训练即可实现图像修复和类别编辑两类图像编辑任务。

本科生领衔

BiFlow有两位项目负责人。

陆伊炀,江苏南通人,清华姚班大二本科生,目前在MIT计算机科学与人工智能实验室(CSAIL)实习,导师是何恺明,主要研究方向为计算机视觉和深度生成模型。

高中时期,他是物理竞赛生,曾以江苏选手中第一名、全国第九名的成绩,在2022年获得了第三十九届全国中学生物理竞赛(CPhO)金牌。

Qiao Sun,MIT大二本科生,目前是何恺明计算机视觉课题组的本科生研究机会项目(UROP)学生。研究主要集中在生成模型方面,如扩散模型、流匹配等。

Qiao Sun高中毕业于上海中学,是2023年国际数学奥林匹克竞赛(IMO)金牌得主。

论文的另一位一作是王衔邦,今年刚从人大附中毕业,进入MIT学习。他的导师同样是何恺明。

王衔邦还是一名双料竞赛生,在2024年IMO上摘得金牌,还在2021年和2022年获得过全国信息学奥林匹克竞赛的银牌。

论文地址:

https://arxiv.org/abs/2512.10953v1

— 完 —

- DeepSeek识图模式是个新模型?!一手实测在此(没错我被灰度到了)2026-04-30

- DeepSeek不惜代价保住它!V4关键特性被挖出来了2026-04-28

- DeepSeek V4终于发布!打破最强闭源垄断,明确携手华为芯片2026-04-24

- 黄仁勋率先开源量子AI大模型2026-04-15