刘壮陈丹琦新作:开源通用视觉推理RL框架,0思考数据刷新SOTA

广泛的数据是视觉推理强化学习Scaling的主要驱动力

鱼羊 发自 凹非寺

量子位 | 公众号 QbitAI

适用于通用视觉推理的强化学习(RL)框架,终于有开源版本了!

来自普林斯顿刘壮团队,陈丹琦亦参与其中。

项目名Vero,基于这一方案构建的视觉推理器,能够胜任图表、科学、空间理解和各种开放视觉任务,在30多项测试中达到了8B视觉语言模型的SOTA。

在此之前,尽管GPT、Gemini等最强大模型们已经把视觉推理玩出了花,但其背后的强化学习方案还是各大厂商的“独门秘籍”,开源方案们大多只能覆盖特定视觉任务。

而Vero的出现,用项目负责人刘壮的话说,证明了“即使在学术环境下,只要有合适的人才和投入,我们也能够追赶上顶尖工业界团队所取得的部分成就”。

用于视觉推理的开源RL方案

想要打造全能型的看图推理“高手”模型,通常会遇到两类问题。

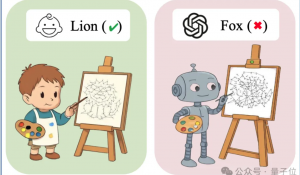

其一,是基于开源RL方案,VLM往往只擅长某一种任务,比如数学题、图表,换个任务就抓瞎。

其二,如果拿多种任务一起训练VLM,模型还容易出现越学越乱、越学越崩的现象。

Vero团队发现,背后的原因在于,不同的视觉任务会放大不同的推理策略,比如图表QA需要数值提取和比较,而定位任务则需要空间扫描和绑定。

针对这些问题,Vero团队主要做了三件事。

Vero-600K数据集

首先,研究人员从59个数据集中精心挑选、过滤并构建了一个包含60万高质量样本的多样化训练集。

这些样本被分为六类:

- 图表与OCR(Chart & OCR)

- STEM

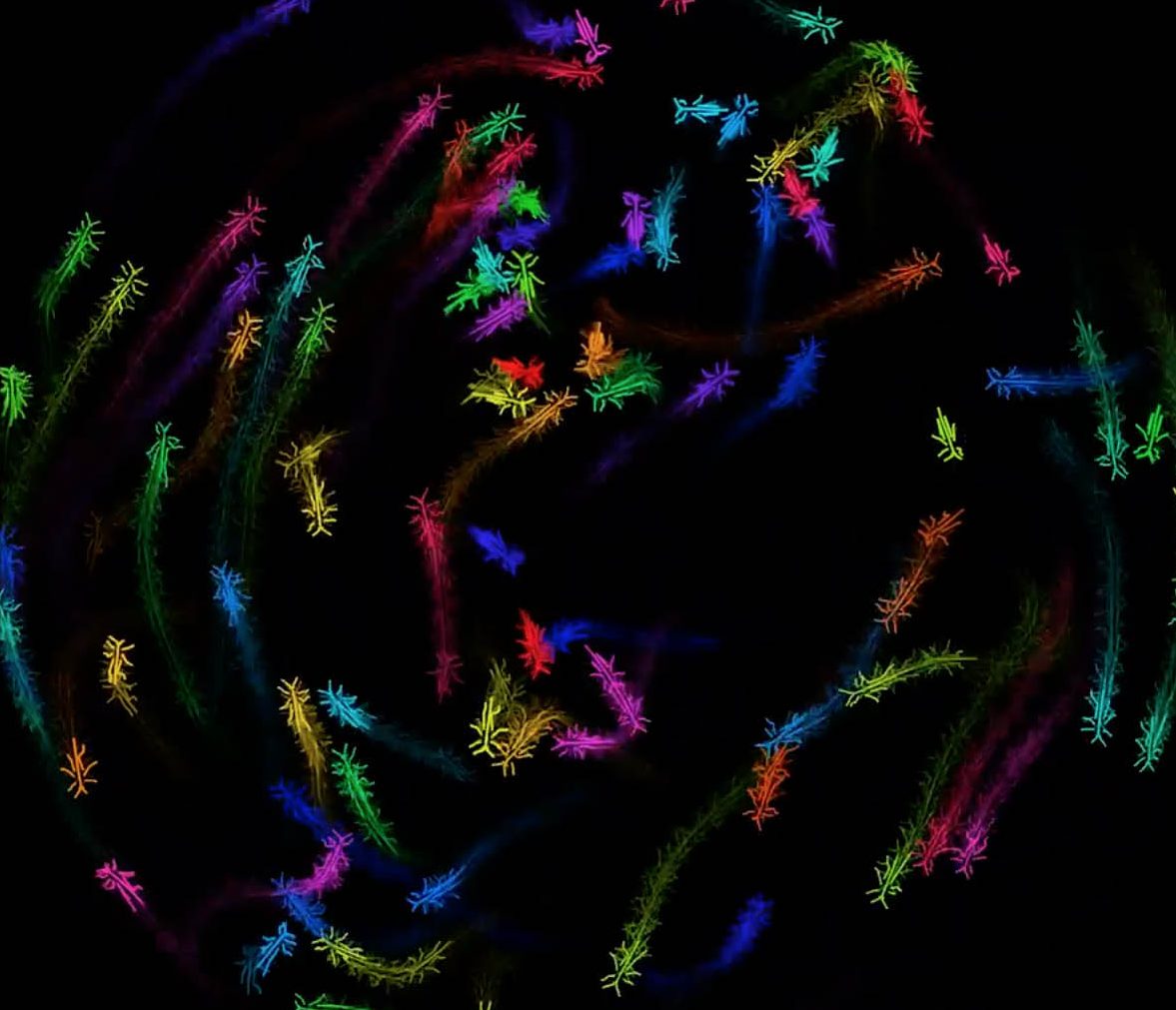

- 空间与动作(Spatial & Action)

- 知识与识别(Knowledge & Recognition)

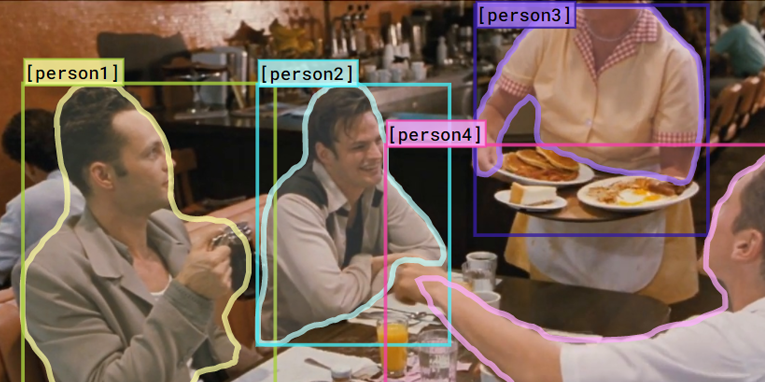

- 定位、计数与搜索(Grounding,Counting & Search)

- 描述与指令遵循(Captioning & Instruction Following)

研究人员发现,单任务RL训练出来的模型无法实现可靠的泛化,针对某一类别的训练往往会降低模型在其他任务上的表现。

相比之下,在广泛且均衡的数据集上进行RL训练, 模型能够学到通用的视觉推理模式,避免了在单一任务上训练导致的能力退化。

任务路由奖励机制(Task-Routed Rewards)

在视觉推理中,不同任务的答案格式之间其实存在很大的差异。

为此,Vero提出了任务路由奖励机制:设计了一套多路奖励系统,能根据任务类型的不同,自动把输出路由给相应的验证器,来分别计算奖励。

比如,对于选择题,评分标准是选项选得是否正确;对于数学题,则需要数学校验;对于开放描述,Vero会引入另一个大模型作为裁判,来评估回答的质量。

单阶段强化学习

相比于闭源模型依赖于私有“Thinking”数据的强化学习方案,Vero提出:

只要拥有高质量的数据过滤、均衡的任务混合,以及精确的路由奖励,仅仅通过单阶段强化学习,就能激发基础模型的通用视觉推理能力。

实验结果显示,在没有引入任何私有“思考”数据的情况下,基于Vero训练的模型在30个基准测试中的23项上,超越了经过专门微调的Qwen3-VL-8B-Thinking。

研究团队的消融实验还表明:

广泛的数据覆盖是视觉推理强化学习Scaling的主要驱动力。

目前,Vero的所有数据、代码、模型均已开源。

研究团队

Vero的两位通讯作者是Gabriel Sarch和Linrong Cai。

Gabriel Sarch博士毕业于CMU,目前是普林斯顿大学PLI(Princeton Language and Intelligence)的博士后研究员——

论文的作者之一陈丹琦,现在也是PLI的副主任。

Linrong Cai,天津第一中学校友。本科毕业于威斯康星大学麦迪逊分校,目前正在攻读普林斯顿大学计算机科学专业硕士学位,师从刘壮。同时Gabriel Sarch也是他的mentor。他的研究方向是视觉语言模型中的推理。

刘壮则是Vero的项目负责人。刘壮本科毕业于清华姚班,后于加州大学伯克利分校获得博士学位,现在是普林斯顿大学计算机科学助理教授。

在CVPR 2017上,刘壮的一作论文DenseNet获得了最佳论文奖。ConvNeXt则是他在Meta FAIR任高级研究科学家期间,和谢赛宁合作发表的成果。

在Meta期间,刘壮和何恺明、LeCun等亦有深度合作。

项目地址:

https://vero-reasoning.github.io/

- DeepSeek V4还能更省!新工具缓存命中率高达99.82%,2折稳定到手2026-05-25

- 腾讯开源 Agent 记忆技术方案,Token 消耗最高降低 61%2026-05-14

- DeepSeek识图模式是个新模型?!一手实测在此(没错我被灰度到了)2026-04-30

- DeepSeek不惜代价保住它!V4关键特性被挖出来了2026-04-28