陈丹琦ACL学术报告来了!详解大模型「外挂」数据库7大方向3大挑战,3小时干货满满

突破大模型自身瓶颈

萧箫 西风 发自 凹非寺

量子位 | 公众号 QbitAI

清华姚班校友陈丹琦,在ACL 2023上做了场最新演讲!

话题还是近期非常热门的研究方向——

像GPT-3、PaLM这样的(大)语言模型,究竟是否需要依靠检索来弥补自身缺陷,从而更好地应用落地。

在这场演讲中,她和其他3位主讲人一起,共同介绍了这个主题的几大研究方向,包括训练方法、应用和挑战等。

演讲期间听众的反响也很热烈,不少网友认真地提出了自己的问题,几位演讲者尽力答疑解惑。

至于这次演讲具体效果如何?有网友直接一句“推荐”给到评论区。

所以,在这场长达3个小时的演讲中,他们具体讲了些什么?又有哪些值得一听的地方?

大模型为何需要“外挂”数据库?

这场演讲的核心主题是“基于检索的语言模型”,包含检索和语言模型两个要素。

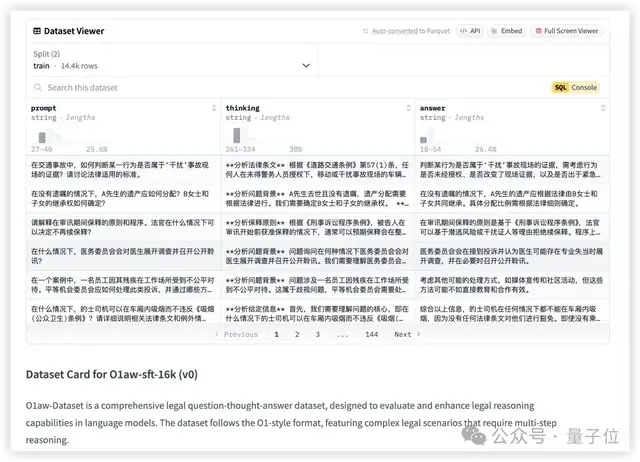

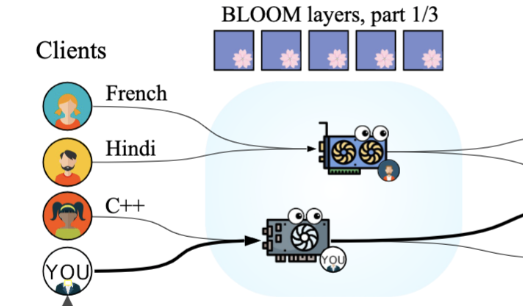

从定义上来看,它指的是给语言模型“外挂”一个数据检索库,并在进行推理(等操作)时对这个数据库进行检索,最后基于检索结果进行输出。

这类外挂数据存储库,也被称之为半参数模型或非参数模型。

之所以要研究这个方向,是因为如GPT-3和PaLM这类(大)语言模型,在表现出不错的效果同时,也出现了一些让人头疼的“bug”,主要有三个问题:

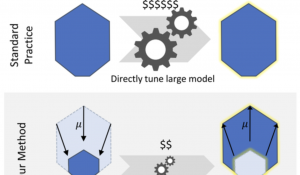

1、参数量过大,如果基于新数据重训练,计算成本过高;

2、记忆力不行(面对长文本,记了下文忘了上文),时间一长会产生幻觉,且容易泄露数据;

3、目前的参数量,不可能记住所有知识。

在这种情况下,外部检索语料库被提出,即给大语言模型“外挂”一个数据库,让它随时能通过查找资料来回答问题,而且由于这种数据库随时能更新,也不用担心重训的成本问题。

介绍完定义和背景之后,就是这个研究方向具体的架构、训练、多模态、应用和挑战了。

在架构上,主要介绍了基于检索的语言模型检索的内容、检索的方式和检索的“时机”。

具体而言,这类模型主要会检索token、文本块和实体词语(entity mentions),使用检索的方式和时机也很多样性,是一类很灵活的模型架构。

在训练方式上,则着重介绍了独立训练(independent training,语言模型和检索模型分开训练)、连续学习(sequential training)、多任务学习(joint training)等方法。

至于应用方面,这类模型涉及的也就比较多了,不仅可以用在代码生成、分类、知识密集型NLP等任务上,而且通过微调、强化学习、基于检索的提示词等方法就能使用。

应用场景也很灵活,包括长尾场景、需要知识更新的场景以及涉及隐私安全的场景等,都有这类模型的用武之地。

当然,不止是文本上。这类模型也存在多模态扩展的潜力,可以将它用于文本以外的任务上。

听起来这类模型优点很多,不过基于检索的语言模型,当下也存在一些挑战。

陈丹琦在最后“收尾”的演讲中,着重提到了几点这个研究方向需要解决的几大难题。

其一,小语言模型+(不断扩张的)大数据库,本质上是否意味着语言模型的参数量依旧很大?如何解决这一问题?

例如,虽然这类模型的参数量可以做到很小,只有70亿参数量,但外挂的数据库却能达到2T……

其二,相似性搜索的效率。如何设计算法使得搜索效率最大化,是目前非常活跃的一个研究方向。

其三,完成复杂语言任务。包括开放式文本生成任务,以及复杂的文本推理任务在内,如何用基于检索的语言模型完成这一任务,也是需要持续探索的方向。

当然,陈丹琦也提到,这些话题是挑战的同时,也是研究机遇。还在寻找论文课题的小伙伴们,可以考虑是否把它加进研究列表了~

值得一提的是,这次演讲也不是“凭空”找出的话题,4位演讲者贴心地在官网放出了演讲参考的论文链接。

从模型架构、训练方法、应用、多模态到挑战,如果对这些话题中的任何一部分感兴趣,都可以去官网找找对应的经典论文来看:

现场解答听众困惑

这么干货满满的演讲,四位主讲人也不是没有来头,在演讲中他们还耐心地对听众提出的问题进行了解答。

我们先来康康主讲人都是谁。

首先是主导这次演讲的普林斯顿大学计算机科学助理教授陈丹琦。

她是计算机科学领域近来最受关注的华人青年学者之一,也是08级清华姚班校友。

在信息学竞赛圈,她颇具传奇色彩——CDQ分治算法就是以她的名字命名。2008年,她代表中国队斩获一枚IOI金牌。

而她的那篇长达 156 页的博士毕业论文《Neural Reading Comprehension and Beyond》,更是一度火爆出圈,不光获得当年斯坦福最佳博士论文奖,还成为了斯坦福大学近十年来最热门毕业论文之一。

现在,陈丹琦除了是普林斯顿大学计算机科学助理教授,也是该校从头搭建NLP小组的联合负责人、AIML小组成员。

她的研究方向主要聚焦于自然语言处理和机器学习,并且对在实际问题中具有可行性、可扩展性和可泛化性的简单而又可靠的方法饶有兴趣。

同样来自普林斯顿大学的,还有陈丹琦的徒弟钟泽轩 (Zexuan Zhong)。

钟泽轩是普林斯顿大学的四年级博士生。硕士毕业于伊利诺伊大学香槟分校,导师是谢涛;本科毕业于北京大学计算机系,曾在微软亚研院实习,导师是聂再清。

他的最新研究主要聚焦于从非结构化文本中提取结构化信息、从预训练语言模型中提取事实性信息、分析稠密检索模型的泛化能力,以及开发适用于基于检索的语言模型的训练技术。

此外,主讲人还有来自华盛顿大学的Akari Asai、Sewon Min。

Akari Asai是华盛顿大学主攻自然语言处理的四年级博士生,本科毕业于日本东京大学。

她主要热衷于开发可靠且适应性强的自然语言处理系统,提高信息获取的能力。

最近,她的研究主要集中在通用知识检索系统、高效自适应的NLP模型等领域。

Sewon Min是华盛顿大学自然语言处理小组的博士候选人,读博士期间,曾在Meta AI兼职担任研究员长达四年,本科毕业于首尔国立大学。

最近她主要关注语言建模、检索以及二者的交叉领域。

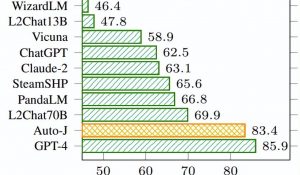

在演讲期间,听众也很热情地提出了众多问题,例如为啥要用perplexity(困惑度)来作为演讲的主要指标。

主讲人给出了细心解答:

在比较参数化的语言模型时,困惑度(PPL)经常被用到。但困惑度的改善能否转化为下游应用仍然是一个研究问题。

现已有研究表明,困惑度与下游任务(尤其是生成任务)有很好的相关性,并且困惑度通常可提供非常稳定的结果,它可以在大规模评估数据上进行评估(相对于下游任务来说,评估数据是没有标签的,而下游任务可能会受到提示的敏感性和缺乏大规模标记数据的影响,从而导致结果不稳定)。

还有网友提出了这样的疑问:

关于“语言模型的训练成本高昂,而引入检索可能会解决这个问题”的说法,你只是将时间复杂度替换为空间复杂度(数据存储)了吗?

主讲人给出的解答是酱婶的:

我们讨论的重点是如何将语言模型缩减到更小,从而减少时间和空间的需求。然而,数据存储实际上也增加了额外的开销,这需要仔细权衡和研究,我们认为这是当前的挑战。

与训练一个拥有一百亿以上参数的语言模型相比,我认为目前最重要的是降低训练成本。

想找这次演讲PPT,或是蹲具体回放的,可以去官网看看~

官方网址:

https://acl2023-retrieval-lm.github.io/

参考链接:

[1]https://twitter.com/AkariAsai/status/1677455831439384582

[2]https://twitter.com/cosmtrek/status/1678077835418955781

[3]https://app.sli.do/event/ok8R2jMMvNjp9uMkxi63Qi/live/questions

- 首个GPT-4驱动的人形机器人!无需编程+零样本学习,还可根据口头反馈调整行为2023-12-13

- IDC霍锦洁:AI PC将颠覆性变革PC产业2023-12-08

- AI视觉字谜爆火!梦露转180°秒变爱因斯坦,英伟达高级AI科学家:近期最酷的扩散模型2023-12-03

- 苹果大模型最大动作:开源M芯专用ML框架,能跑70亿大模型2023-12-07