运行LIama2得8400万元!最快AI推理芯片成本推算引热议

英伟达GPU成本只需30万美元

白交 发自 凹非寺

量子位 | 公众号 QbitAI

想实现史上最快大模型推理,得要1171万美元(8410万元)???

同等项目下,使用英伟达GPU成本只需30万美元……

关于最强AI芯片易主Groq,可能得让子弹再飞一会儿了。

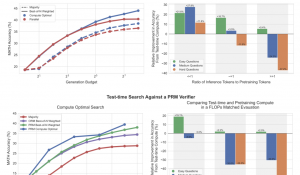

这两天,Groq惊艳亮相。它以号称“性价比高英伟达100倍”的芯片,实现每秒500tokens大模型生成,感受不到任何延迟。外加谷歌TPU团队这样一个高精尖人才Buff,让不少人直呼:英伟达要被碾压了……

喧嚣过后开始出现一些理智讨论,其中主要还是针对Groq的效益成本问题。

网友粗略一算,现在演示Demo就需要568块芯片,花费1171万美元。

于是乎,业内业外各界人士不约而同地展开了一场算术大法。

甚至出现了位分析师,拿着表格现身说法……

并感叹了句:OK,everybody is doing public math this week.

不过Groq也第一时间在社交网络上进行了回应。

“每个人都在做数学”

参与到Groq成本问题讨论的,有计算机学生,也有同提供推理服务的云厂商,甚至还有Groq前员工大战现员工……好不热闹。

摘取几个有代表性的,我们来看看大家都是如何看待的。

首先一个粗略估计,一张卡的价格约为2万美元,内存又仅为0.23GB。

那么为单个LLama 70B模型服务,就需要购买大约320张卡(实际上更多),包括服务器在内大约花费1千万美元……

而要是跟英伟达的H100对比,情况又是如何?

Lepton的贾扬清也参与进来,算了一笔账。除了基本价格,他还从能源功耗、性能、运营成本等角度进行了分析。

最终总结出这几个核心观点:

- 对于LLaMA 70b模型,使用572张卡来计算,每年电费将花费25.4万美元;

- 使用4张H100卡可以实现Groq一半的性能,如今8卡H100盒子的价格约为30万美元。

- 如果运营三年,Groq 的硬件采购成本为1144万美元,运营成本为76.2万美元。相比起来H100采购和运营成本更低。

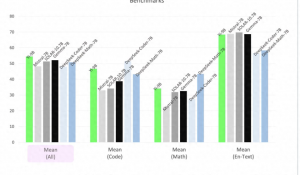

值得一提的是,在Groq给出的基准测试中,也包括了Lepton在内,推理速度大概是Lepton的三倍。

贾扬清还透露,他跟Groq创始人是旧相识了:

在谷歌时就相互知道。

不过在这些讨论中,也有其他算法。

比如有网友反应,按照单个Token价格这个维度来计算,情况又是如何呢?

没关系,还有更专业的分析师会出手。

不过根据他的计算,每100万Tokens的花费,Groq性价比是要高一些。

除此之外,还有一些其他的讨论,像是否支持加速任何Transformer?

Groq在线答疑

由于大家过于关注,Groq忍不住亲自下场解答。

是时候再发一个常见问题帖子来澄清了。

主要有以下几点:

- 采用开源模型,适应我们的编译器,然后运行它,仅此而已。

- 我们token价格很实惠很高效,因为从芯片到系统都自己搞,没有中间商;

- 不会出售芯片,但第三方供应商除外;公布的销售数据有偏差。

- 我们的目标客户不是单卡用户。

另外还在持续地在线答疑中……

所以Groq是否能真的撼动住英伟达的地位,估计还得再等一等。

不过昨天英伟达股价倒是异动了一波……

参考链接:

[1]https://twitter.com/GroqInc/status/1760113134566576558

[2]https://twitter.com/swyx/status/1760065636410274162

[3]https://news.ycombinator.com/item?id=39428880

[4]https://twitter.com/JayScambler/status/1759372542530261154

[5]https://twitter.com/DZhang50/status/1759839771487297637

- 空间智能卡脖子难题被杭州攻克!难倒GPT-5后,六小龙企业出手了2025-08-28

- 陈丹琦有了个公司邮箱,北大翁荔同款2025-08-28

- 英伟达最新芯片B30A曝光2025-08-20

- AI应用如何落地政企?首先不要卷通用大模型2025-08-12