最新“3D版”DALL·E爆火,超快速度生成3D点云模型,OpenAI向谷歌新领域发起挑战丨开源

只需V100运行2分钟

萧箫 发自 凹非寺

量子位 | 公众号 QbitAI

这边AI画画的热度还没下去,OpenAI已经连“3D版”AI画画都搞出来了。

没错,用文字生成3D点云模型,还是超——快的那种!

只需要一张英伟达显卡,两分钟就能生成一个3D小物件,比谷歌的文生3D模型DreamFusion快了接近600倍 (但它们生成的不是同一种3D模型)。

项目代码开源后在网上爆火,英伟达AI科学家甚至大胆预测:

2023年会是3D模型爆发年,可以期待一波3D版Stable Diffusion和MidJourney了。

现在Point·E模型的Demo已经在Hugging Face上放出,想要玩的小伙伴们可以上手试试~

如何快速生成3D点云模型?

顾名思义,Point·E并非一个直接生成3D模型的AI。

相比谷歌DreamFusion直接生成能用于渲染的3D网格图,它生成的是一个3D点云模型(Point Cloud),至于Point·E的E则是效率(efficiency)的意思。

据作者介绍,之所以选择从3D点云模型突破,是因为目前AI生成3D模型的一大缺陷就是速度慢,用GPU渲染需要好几小时才能生成结果。相比之下,2D图像生成却只需要几秒钟。

因此,加速3D模型生成的效率同样非常重要,在此基础上Point·E应运而生。

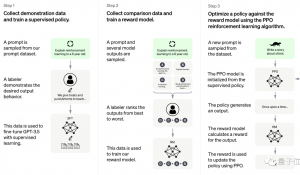

在文本生成3D点云上,Point·E并非“一步到位”,而是将过程分为了三步。

首先,如红色框展示的,模型会先基于文本生成一个“预览版视图”。

这一步基于OpenAI去年发布的30亿模型GLIDE微调实现,用它生成的视图还不具备“3D特性”,相当于只是给了个参考范例。

随后,如黄色框所展示的,Point·E会采用一个扩散模型,根据“预览版视图”生成一个粗糙的3D点云模型(这里的粗糙指分辨率较低,只有1024个点)。

具体架构如下:

最后,再用一个更小的扩散模型,采用上采样(upsample)将获得的3D点云模型进一步细化,得到最终的精细版3D点云模型(一共有4096个点)。

具体的训练过程,用了一个包含数百万个3D模型的数据集,其中每个模型都被处理成渲染视图、文本描述和3D点云三部分。

用这种方法生成的3D点云模型,在处理速度上确实快了不少。

比DreamFusion快数百倍

先从生成时间来看,无论是DreamFields、还是DreamFusion,在生成上都需要以小时为单位计数。

其中DreamFields是效果比较好的AI文本生成3D模型,但生成一个模型几乎需要单张显卡运行200小时。

DreamFusion是DreamFields的进化版,即便如此它也需要12个小时。

相比之下,Point·E的几个不同大小的模型,基本都以分钟为单位,在1分钟~1.5分钟内就能完成文本生成3D点云模型。

不过,Point·E在生成效果上,还确实不如谷歌的DreamFusion,后者可以直接渲染生成3D模型:

相比之下,作为一个文本生成3D点云AI,Point·E无法像DreamFusion那样用网格(mesh)直接生成3D模型。

在经过渲染前,这些点云需要先完成预处理,经历一个网格化的过程,往往这个过程还需要耗费额外的时间:

作者也指出了Point·E存在的一些缺点。

一方面,有时候经过预处理,比较稀疏的点云可能会被忽略(例如下图中花的茎秆等地方):

另一方面,从预览图生成点云的过程,有时候也会出bug。例如AI看着预览图,生成了一个完全不匹配的3D点云效果出来:

△超高版柯基和对称雪糕筒

即便如此,不少网友认为AI生成3D模型的未来值得期待:

如果速度再快一点的话,或许就能让6岁的小孩在iPhone上自己造元宇宙了(手动狗头)

试玩地址:

https://huggingface.co/spaces/openai/point-e

论文地址:

https://arxiv.org/abs/2212.08751

- 首个GPT-4驱动的人形机器人!无需编程+零样本学习,还可根据口头反馈调整行为2023-12-13

- IDC霍锦洁:AI PC将颠覆性变革PC产业2023-12-08

- AI视觉字谜爆火!梦露转180°秒变爱因斯坦,英伟达高级AI科学家:近期最酷的扩散模型2023-12-03

- 苹果大模型最大动作:开源M芯专用ML框架,能跑70亿大模型2023-12-07