狂徒AI对罗翔老师下手了

火爆全网AI的技术大揭秘

金磊 发自 凹非寺

量子位 | 公众号 QbitAI

朋友,有没有想过自己在二次元里长什么样?

最近就有这么样的一个生成器在国内外火了。

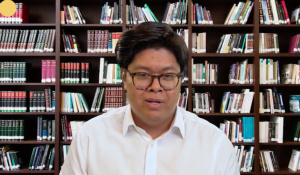

瞧,输一张罗翔老师的照片,“啪的一下”就能生成二次元漫画风:

一键秒变霸道总裁有木有,引得网友纷纷前来围观。

甚至就连KFC(肯德基)官方账号都来凑起了热闹,亲自打破自家老爷子的次元壁:

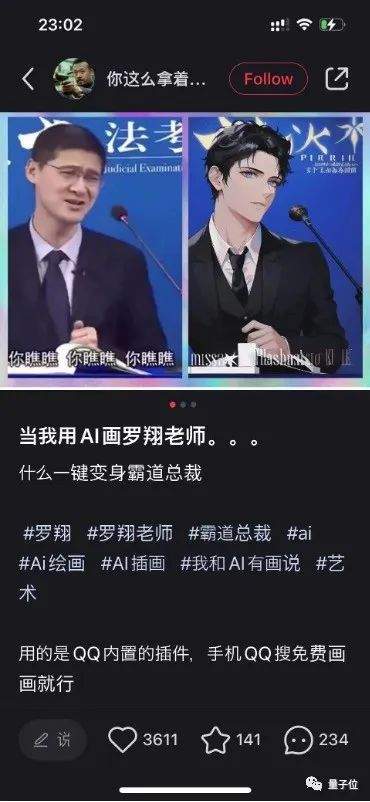

各类梗图更是层出不穷:

在二次元滤镜下,就连这张经典的“女人吼猫”都透露出一丝温馨,“竟然都有点可爱了呢”。

这就是QQ小世界在近期推出的二次元形象生成器——“异次元的我”。

那么这层次元壁,又是如何打破的呢?

只需上传一张照片

据了解,在QQ小世界“异次元的我”相关话题之下,已经有突破100万的投稿量,浏览量更是上亿。

甚至一度还把QQ服务器给挤爆了:

而之所以会呈现如此“全民参与”的态势,离不开打破次元壁的简单操作。

只需要搜索一句“免费画画”,便可以看到入口了:

然后仅需现场拍照,或上传图片即可:

而且为了能让二次元风格图能够hold住各式各样的图片,“异次元的我”还设置了不同的使用场景,让适配度变得更高:

不得不说,打破次元壁这件事,现在真心变得好easy。

那么接下来的一个问题便是:

什么原理?

近年来,扩散模型(Diffusion Model)在图像生成领域中蓬勃发展。

例如OpenAI的GLIDE和Google的Imagen,都采用了基于扩散模型的pipeline来获得高质量的图像生成结果。

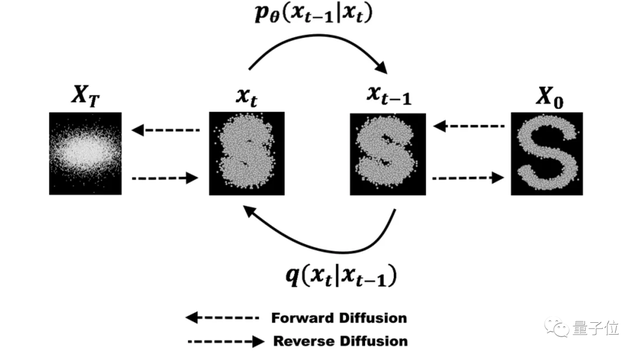

扩散模型分为两个过程。如下图所示,右边是一张正常的图片。

从右到左的Forward Diffusion是一个逐步地将正态分布的噪声叠加到图片上的过程,最终得到一张看起来完全是噪声的图片。

可以不严谨地想象成往一块牛排上不断撒椒盐,直到它看起来完全被椒盐覆盖,看不清原来的纹路。

从左到右的Reverse Diffusion则是一步步去除噪声,试图还原图片,这就是扩散的生成数据过程。

而扩散模型的训练就是在学习预测叠加在xt上的噪声,从而得到去噪后xt-1的图片,经过一轮又一轮的去噪,得到最终无噪声的输出图X0。

最新的Stable Diffusion模型,则是在此基础上结合了一个训练好的VAE模型。

VAE模型可以对任意图片进行压缩再解压,将图片使用VAE的编码器压缩后能得到比原图小很多的特征编码,再基于特征编码训练扩散模型,最终生成的特征编码再使用VAE的解码器还原回原始尺寸的大图,这就是Stable Diffision的做法。

这一改进大大减少了图像生成的时长和占用的GPU资源,使得落地成为可能。

为了能够使用文字控制模型生成的内容,Stable Diffusion模型使用了预训练的CLIP模型来引导生成结果。

CLIP模型使用了大量的文字和图片对训练,能够衡量任意图片和文本之间的相关性,即CLIP-score。

在前向生成图片的过程中,模型除了要去噪以外,还需要让去噪后的图片和引导词的CLIP-score尽量大。

这样在不断生成过程中,输出结果就会越来越接近我们给定的文字描述。

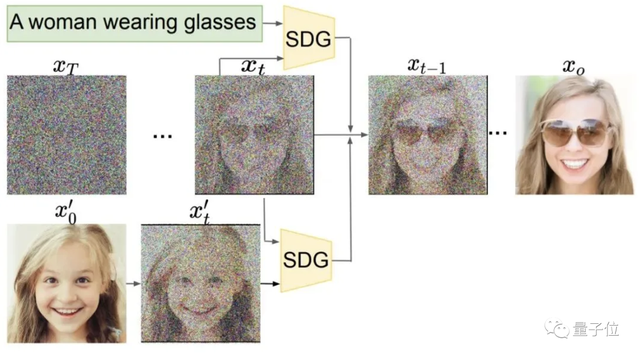

在上图中,左下角的小朋友的脸先被叠加了一定程度的噪声。

之后在去噪过程中,会不断拉近生成结果图和“a woman wearing glasses”的距离,从而使得生成结果逐渐变成了戴眼镜的成年女性。

生成图片依然能够保留原始图片的大致结构,但是细节却在文字的引导下发生了变化。

Stable Diffusion技术在AI画画尤其是二次元领域中展现出非常高的观赏性和娱乐性,各家纷纷推出基于Stable Diffusion的AI画画平台,如draft.art、意间AI等。

但当时现有的平台在使用上非常不便捷,如果直接生成,大概率生成的质量不会很高,还容易遇到翻车现场:

如果用户想要生成比较好的结果,就需要对图片内容进行详尽的描述,并增加很多提升效果和强化风格的词,才能得到一个比较理想的效果。

而且界面可调的参数非常多,用户使用门槛很高;另一方面,对于资源的消耗导致这些平台通常需要排队非常久才能拿到一张结果。

因此,QQ小世界团队针对这些痛点进行了优化改造,用户只需要上传一张图片,即可得到好看稳定的生成效果,降低了使用门槛的同时也保证了生成质量。

在技术上,研究人员主要进行了以下几点优化:

- 准确的内容生成:通过自研diffusion模型对生成语义进行强化,并辅助图片内容分析提升生成内容对应性;

- 更快的生成速度:利用超分模型减少difussion模型的生成分辨率,并针对图像inference过程进行加速,提升生成速度,节约GPU资源;

- 多样的风格选择:针对不同的场景设计了丰富且美观的风格化效果。

另外,在设计玩法时简化了用户的使用流程,为了让用户使用门槛更低、体验更好,研究团队通过口碑积累达到了峰值1000%的二次传播率。

之前的一些AI画画平台,如意间AI,draft art等,除了上传图片,还需要使用一系列的描述主体和风格的引导词(prompt),有时候还需要调整不同参数,来得到一个理想的结果。

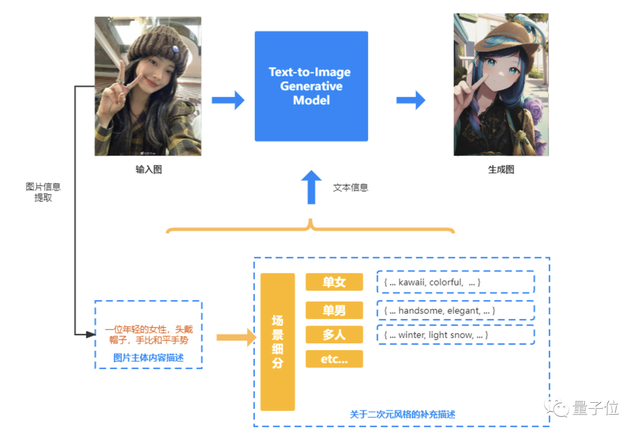

为了降低用户的使用门槛,“异次元的我”对pipeline进行了改进:

将输入模型的提示词分为两个部分——图片主体内容描述和风格描述。

内容描述:为了得到图片的内容描述,对输入图中的信息进行人物性别、年龄、姿势等属性的检测,得到最终尽可能准确详尽的内容描述词。

风格描述:为了让结果更接近二次元,为各种不同场景设计了非常鲜明的二次元风格。根据第一步对图片内容进行分析后,进一步细分为单人男性、单人女性、多人等不同场景。

结合内容描述和风格描述,研究人员通过对原图的分析得到最终完整的提示词输入网络,从而能够稳定生成画面精致、风格突出的结果。既保证了生成内容和原图的对应性,又增添了很多“异次元”要素,让用户更有穿越到二次元的感觉,同时也保证了较高的生成质量。

另一方面,自研diffusion模型针对语义理解进行了强化,能够更准确理解和生成图片的主体内容,在语义信息理解和图像生成质量上均有明显提升。

和近期推出相似玩法的其它平台对比,“异次元的我”在内容准确度上会更好,风格也更加二次元化、更美观:

据了解,原始的Stable Diffusion由于需要通过多次迭代生成图片,在默认配置A100机器上生成一张720p的图像耗时约12s。

如果需要通过提升分辨率和增大迭代步数来提升效果,耗时更是需要多达一分钟。

而“异次元的我”针对自研模型采取了一系列的模型压缩和工程加速的方案,最终一张图片的生成速度是1.6s,提升了7倍。

……

那么对于这种“快、好、省”地变二次元的玩法,你心动了吗?

按照下面的方法快去试玩吧:

在QQ搜索“免费画画”即可参与。

One More Thing

QQ小世界团队最初只是想着在国内搞“异次元的我”,但不知为何被传到了外网并火了起来,不过期间也是闹出了一些小乌龙。

而QQ小世界团队得知此消息后,火速优化了算法。现在“异次元的我”可以兼容各种肤色,生成多元图片。

对此,海外用户也对团队的优化表示了肯定:

看来,不仅是人类需要不断学习进步,AI亦是如此。

- 刚刚,“云计算一哥”版龙虾发布,奥特曼打着官司也要云站台2026-04-29

- 河南师傅,左手扳手,右手飞书,竟然能搞数据分析!2026-04-23

- 神秘模型「大象」:仅100B拿下SOTA,Token效率超高!2026-04-22

- 国内首家百亿估值纯推理GPU独角兽诞生!专访曦望联席CEO王湛:谁的推理成本更低谁就是赢家2026-04-23