他在京东每天做1000万次图灵测试

AI的复兴往事

允中 发自 凹非寺

量子位 报道 | 公众号 QbitAI

△电影《模仿游戏》,改编自《阿兰·图灵传》

一千人眼中有一千个哈姆雷特,从阿兰·图灵(Alan Turing)博士第一次提问 “机器会思考吗?”并设计出图灵试验算起,70年来AI领域涌现的杰出人物灿若繁星,像推动最近这一轮AI复兴的深度学习三巨头Bengio、Hinton、LeCun,以及创造了AlphaGo的Demis Hassabis等。几代学者接力棒般地努力,将人工智能从科学猜想一步步推向现实,呈现给大众。

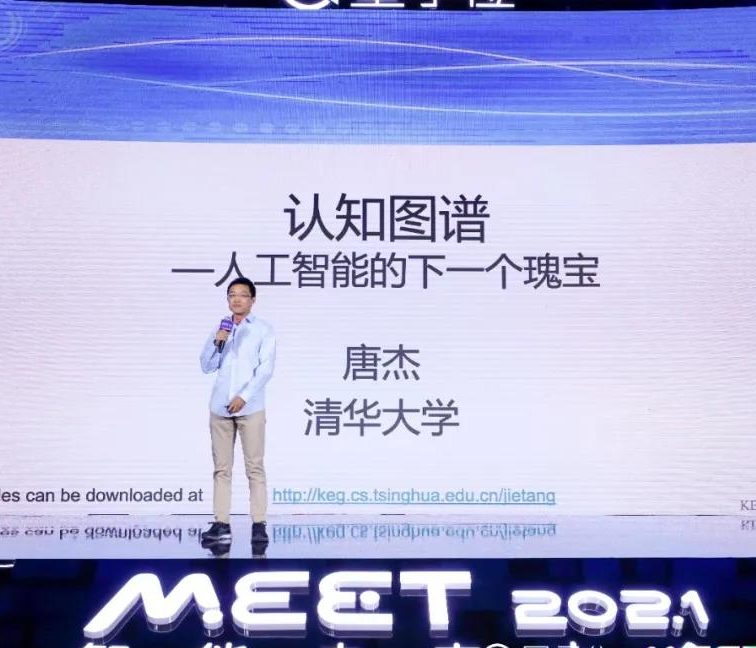

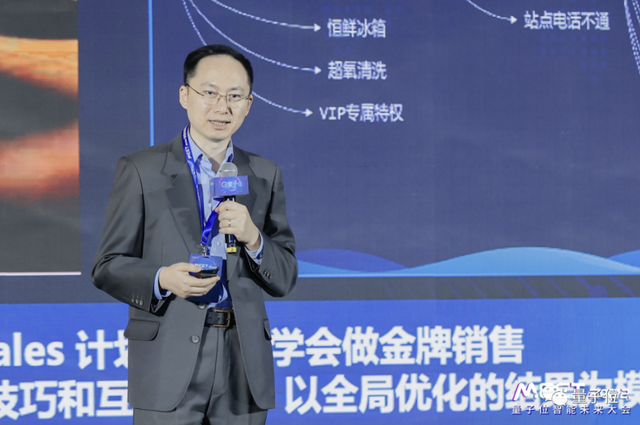

在MEET2022智能未来大会上,京东的何晓冬来到了活动现场,讲述了京东在技术方面的进展,以及在各产业的应用。

△ 何晓冬在量子位 MEET 2022演讲

作为一家新型实体企业,京东自2017年初全面向技术转型以来,已在技术上累计投入近750亿元,展示了京东对于技术和人才的重视,并将内部沉淀和打磨多年的技术全面向社会开放,帮助外部合作伙伴实现数字化升级。

此外,依托丰富的场景和在智能供应链方面的优势,京东也吸引了众多优秀的科学家加盟。

何晓冬便是其一。

他在自然语言处理、多模态智能等领域深耕多年,有着众多研究成果,并将这些成果大规模的应用在京东和产业界。

活动结束后,我们还聊了聊他经历的AI复兴往事。

最早一批投身深度学习的AI科学家

何晓冬本科毕业于清华大学,硕士毕业于中国科学院,后赴美国密苏里大学哥伦比亚分校学习,获得博士学位后加入微软。从2012年至今,他还在位于西雅图的华盛顿大学电机与计算机系兼任教授、博士生导师。

在加入京东前,何晓冬就职于微软雷德蒙研究院(MSR Redmond),任首席研究员(Principal Researcher)及深度学习技术中心(DLTC)负责人。雷德蒙研究院是微软全球八大研究院之首,位于微软总部。

在这里,不仅有海量高影响力学术论文诞生,还有众多学术研究成果被转化到微软产品中去。比如微软在隐私保护方面的机器学习算法、DNA存储数据系统的开发,都是雷德蒙研究院的成果。

此前举办多年的微软研究院技术节(TechFest)也是在这里举办,对微软乃至整个业界都有着举足轻重的影响。

在学术界这些年,何晓冬提出多个基础方法和经典模型,推动和启发了众多国内外科技创新。

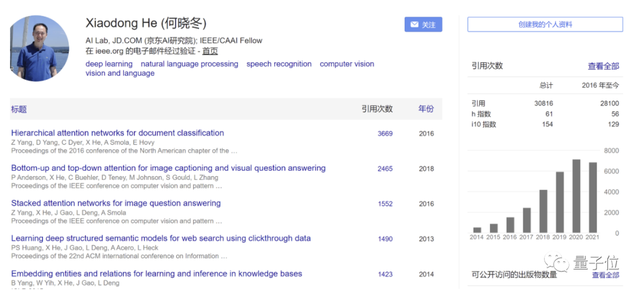

在自然语言处理、语言与视觉多模态智能等领域,他发表论文200余篇,谷歌学术引用3万余次;其中前10篇代表作的引用超过15000次,并多次获得ACL杰出论文奖、IEEE SPS最佳论文奖等奖项。

△何晓冬的谷歌学术主页

比如在2014年,他与深度学习三巨头之一Yoshua Bengio等人给IEEE TASLP投稿的《Using RNN for Slot Filling in Spoken Language Understanding》,提出了基于深度循环神经网络的口语理解模型,为口语理解领域带来突破。

六年之后,该论文获得2020年度IEEE 信号处理协会 (IEEE SPS)最佳论文奖。跟一般顶会的最佳论文奖不同,这个奖是从过去6年里发表于IEEE SPS的所有论文里评选,相当于经过了时间的检验。

何晓冬还为此感慨道,AI领域发展很快,这个工作萌发idea的时候,这些作者里还只有一位IEEE Fellow,获奖的时候,作者群里已经7位Fellow加一个图灵奖了。

、又比如2018年,何晓冬与沈向洋、李笛等人在中国工程院刊FITEE发表论文《From Eliza to XiaoIce: Challenges and Opportunities with Social Chatbots》,深度探讨了构建先进人机对话系统的设计原则,获得业界广泛关注,并获得2018年度优秀论文奖。

基于其对自然语言理解和语言与视觉多模态信息处理的贡献,2018年底何晓冬当选IEEE Fellow。

此外,他还曾担任IEEE西雅图分会主席及多个顶级学术期刊编委。

在今年清华-中国工程院知识智能联合研究中心推出的AI 2000人工智能全球最具影响力学者榜单中,何晓冬同时入选自然语言处理、语音识别、信息检索与推荐3个领域。在这个榜单里,跨3个及以上领域入选的学者全球只有61位。

二十载学术生涯中,何晓冬的研究贯穿了语音识别、语言理解、图像与语言多模态信息处理等领域。也正好在这一时期,深度学习及人工智能技术迎来新一轮爆发。

深度学习爆发的见证者、参与者

正如乔布斯在斯坦福大学那场著名的演讲中所言,人生中很多事件其间存在巧妙关联,但要在多年后回望时才会发现。

这一点在何晓冬身上也有印证。

站在当下这个节点上,何晓冬回望走过的路,何晓冬对我们讲述了自己亲历的深度学习发展中的几个片刻。

关于这个故事,还要从2006年说起。

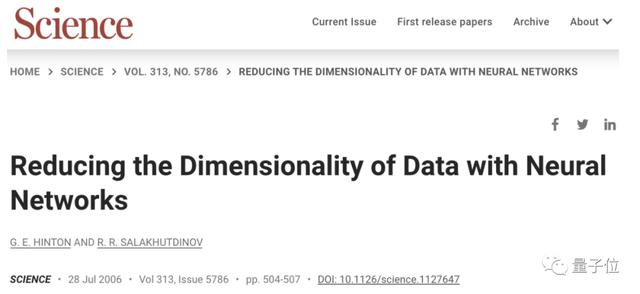

当年,深度学习三巨头之一Geoffrey Hinton在顶刊Science上发表了一篇论文,名为《Reducing the Dimensionality of Data with Neural Networks》。

虽然当时人们认为这篇论文并不好懂,但现在回头来看,这篇论文可以称得上是这次深度学习浪潮的起点。

而彼时何晓冬考虑的,却是另外一个问题:需要什么样的算法才能在像大规模语音识别、机器翻译这类硬核的AI任务上产生真正的突破?

在他看来,很多算法、理论确实够前沿新颖,但当真的用到实际问题中时,效果却差强人意。

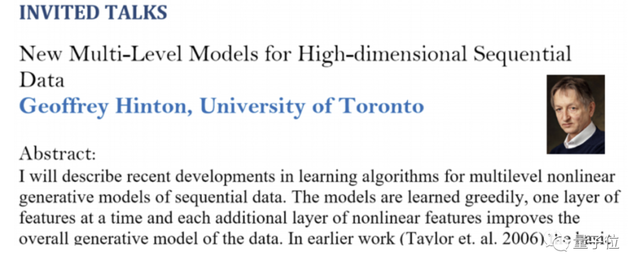

之后在2008年的机器学习顶会NeurIPS(当时叫做NIPS)上,他和当时微软的同事邓立便举办了一场语音语言研讨会(NIPS Workshop on Speech and Language: Learning-based Methods and Systems),同时也邀请Hinton来做报告。

之后邓立还邀请Hinton去微软“做客”,期望将他提出的最新理论,拓展应用到公认很难的大规模词表语音识别任务中去。

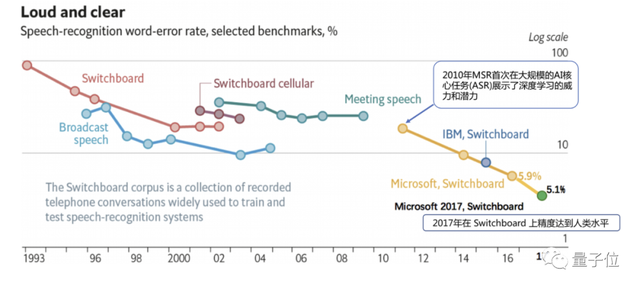

而就是这一次合作,让大规模语音识别这件事在2010年,第一次出现了非常明显的进步。

具体而言,深度学习将大词表语音识别性能突破性提升了20%,可以说是开启了后来一系列人工智能硬核任务上的突破。

以Switchboard数据集上的语音识别性能测试为例,在此之前,基本错误率都高到没法在实际场景中大规模用起来。

而从2010年开始,大词表语音识别的错误率每年都在迅速下降。

到了2017年,在Switchboard上的错误率被降低至5.1%,这也是首次在这个数据集上AI达到了人类职业速记员的水平。

但实际上,2010年那次深度学习在语音识别上取得突破的影响,远不止于此。

重点是它让大家对深度学习、神经网络看法发生了改观——

“原来这是条可行的路”。

于是,在这扇大门敞开之际,深度学习领域与之相关的各项研究都开始遍地开花。

比如图像识别方面,以ImageNet项目为例,在2012年Hinton和他的学生研发的深度学习模型将物体识别的错误率降低了1/3。并且随后每一年识别错误率都在持续大幅下降。

在2015年,深度学习模型在ImageNet数据集上把识别错误率降到了3.57%,首次超越了人类的5%错误率的水平。

而且不单是对语音和图像的识别,理想中的AI应该是能像人一样去理解语言背后更深层的语义,就是说AI需要从感知智能进化到认知智能。

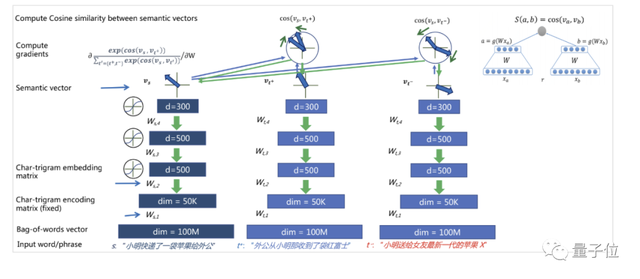

在此理念之下,何晓冬等人投身其中,探索从自然语言中提取出抽象的语义并将它投影到一个语义空间,以此来帮助搜索、推荐、分类、问答等实际应用。

具体而言,他们在2013年提出了深度结构化语义模型DSSM(Deep Structured Semantic Models),将多样化的自然语言所表达的含义,表示成为一个多维度连续语义空间中的向量。

值得一提的是,该模型产生的影响可谓深远,不仅仅在学术界被引用过千次,在工业界也极具适应性。

时至今日,几乎所有做搜索推荐场景的大厂仍在使用DSSM及其衍生模型,其影响力度可见一斑。

除了语言之外,在2015年的一个工作中,他们将知识也用向量、矩阵等方式来表征并投影到高维连续语义空间中。

更进一步,语音、语义或图像上的突破还只是单一领域的智能,而人类的智能更为复杂丰富。

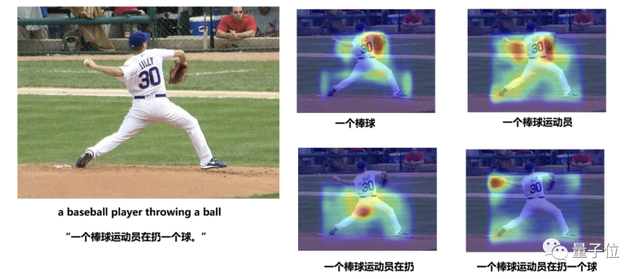

比如就像我们人类看下面这张图一样,很自然就能够get到图片中人物的活动,并用语言去描述出来,而不只是简单的检测出图中的人和物。

同样在2015年,在CVPR(计算机视觉顶会)上深度学习巨头Yan LeCun 等人召集了一场深度视觉研讨会(DeepVision Workshop),邀请Yoshua Bengio等就“视觉的未来”各抒己见。

会上,何晓冬在报告中提出了一个观点,便是语言-视觉深度多模态语义模型(DMSM),也就是AI在描述一张图的时候,是否能够在语义层面上达到一个等价的匹配。

换句话说,就是我们常说的“看图说话”,文字描述出来的话和图片的内容在语义上要是一致的。

而何晓冬他们提出的DMSM模型就是一个具体实现的算法,能够把图像和文字都表示成为同一个跨模态语义空间内的向量。

而后在这个空间中进行跨模态语义匹配计算,从而帮助生成最匹配图像内容的文字表述。

例如在这个模型下,AI在看到下面的这张图片时,便可在识别和理解图像蕴含的丰富语义,并生成准确的语言描述。

△何晓冬等在CVPR2015发表的关于视觉和语言多模态图像描述的论文

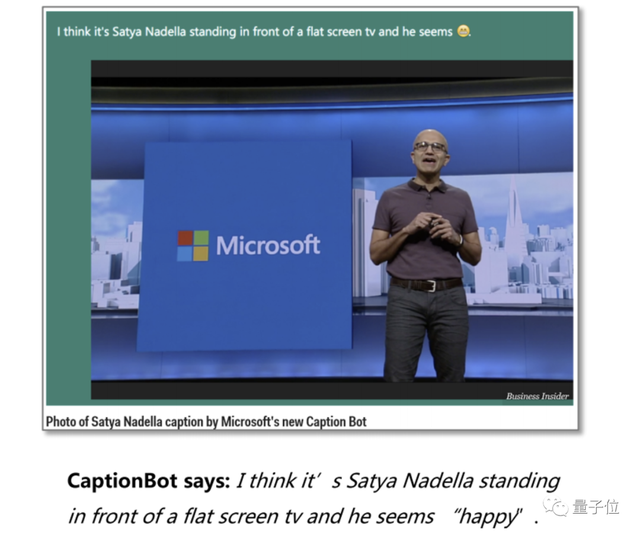

而且不仅只是语言、图像,何晓冬和他的同事后来又将知识融入到了多模态模型中。

这样做的效果,便是AI在“看”到有具体人物、地标的图片时,就不仅仅会将其描述为“一个运动员”这样的笼统的信息。

而是会把描述的语言变得更加细致,例如AI就会把图片中的具体人物“纳德拉”都说出来。

2016年,微软CEO纳德拉在微软Build大会中便展示了这项技术。

△Business Insider媒体报道CaptionBot

何晓冬带领团队开发的这款名为CaptionBot的AI 应用,精准描述了图片中纳德拉的言行举止,还能够描述人物情绪。

一时间,跨语言、视觉以及知识的多模态技术迅速实用化,该应用也迅速走进了大众的视野当中。

深度学习崛起和发展过程中有种种“巧合”,但其实更有赖于很多技术人对技术执著的 “信念”。何晓冬自嘲说,感觉他就像电影《阿甘正传》里的阿甘一样,很幸运的见证了这一轮AI复兴浪潮的关键节点,还有幸能在其中做了一点贡献,也像是经历了一个技术人的“奇幻之旅。”

回国,加盟京东

时间拨转到2018年,彼时在微软雷蒙德研究院已经工作十余载的何晓冬,选择回到国内,并加盟京东。

这一决定在外界看来或许有些突然,但于其本人而言,或许更是一种必然。

就像第一台通用计算机刚刚被发明出来时一样,最大的问题是如何让它去做我们想让它做的事,发挥出它的潜力和价值。

作为深度学习新一轮浪潮的亲历者与参与者,何晓冬深感应用之于AI的意义。

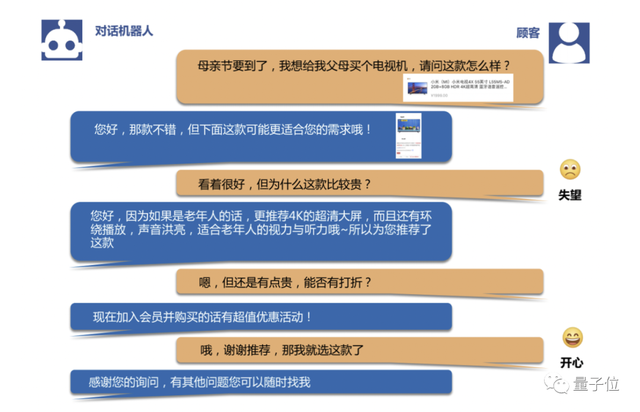

他以研究多年的智能客服应用举例说明。客服是智能人机对话与交互技术的重要落地场景,让AI和人沟通就成为了必然的挑战。

而在和人类沟通的过程中,AI不仅要听懂人类说的话或者看懂人类输入的文字,还要理解人的深层意图去组织语言,甚至还是一系列的博弈与决策(比如该做什么、该怎么回复、该询问补充信息还是立刻回答、该采取什么交互策略等等)……这一切使得实用场景成了最好的训练场。

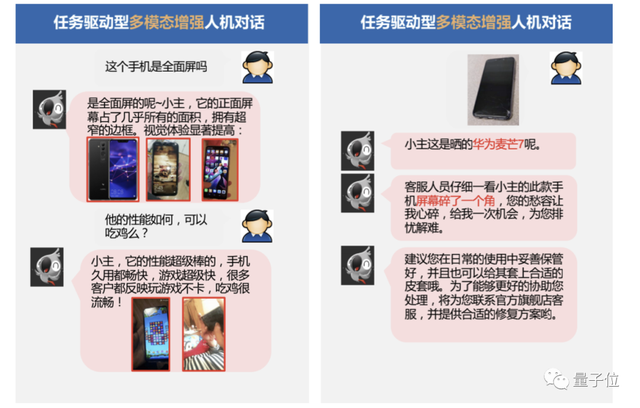

△售前咨询对话的一个案例

何晓冬针对AI的进展做了一个判断,当下AI技术的三要素已经从(静态的)数据、(单一任务的)算法、算力转化为(交互行为的)场景、(多任务协同的)系统和算力新三要素。

根据复杂的应用中发现的问题反过来推动基础技术的发展,也成为如今AI发展的一种新趋势。

由此,何晓冬在2018年更紧密的拥抱场景、走向京东。

加盟京东后,何晓冬一方面在北京、成都、硅谷等地组建语音语义与智能人机交互技术实验室,聚焦多模态人机对话等前沿课题,另一方面组建智能客服产品部门推动实验室产出的前沿技术落地到大规模产业应用。

比如他和团队研发了产业界第一个大规模商用的情感智能客服系统—言犀,涵盖客户服务、营销导购、流程自动化等客户全生命周期管理与服务的智能化解决方案。

我们日常打开京东APP和智能客服沟通时,用到的就是这一系统。

它可以贯穿售前、售中、售后全线场景,其最大的特点就是可以在多轮对话中识别到用户的情绪,从而调整自己的应对策略,情绪判断准确率可以逼近到90%。在用上这套情绪评估系统后,京东平台上,客户的满意度带来了明显的提升。

更人性化的是,它还能识别出客户的极端情绪。比如有人询问一次吃100颗安眠药会死吗?智能客服系统就会发出预警,并联系当地公安、社区志愿者予以介入干预挽救生命。

不只是文字内容,顾客发来的照片它也能“看懂”,而且还能用图片+文字的形式回复顾客,好像真人一般。

当然,遇到解决不了的问题时,智能客服也会及时切换人工客服,保障用户问题能够快速被解决。

目前,它已在京东平台上服务超过5.5亿客户。而且,这套言犀系统能做到的,还不止于此。

它还能对外提供解决方案。

在政务行业,言犀为大同12345提供政务热线解决方案,目前接通率提升到 100%,事项办结率提升到97.9%,让广大市民 “打得进,听得懂,办得快”。

在金融行业,言犀为江南农商银行打造了的VTM数字员工,是全国首个能独立全程办理银行真实交易的数字人,实现了从传统的咨询、查询、导览到业务办理的突破。

在制造行业,言犀为中联重科打造了泵送机械AI专家诊断系统,每年可创造超过230万元的经济效益,节省了大量故障排查成本。

言犀也为更多人带来了实实在在的价值与便利。对于在山西大同12345工作的于怡然来说,在智能化改造之前,接听热线全靠人工,矛盾突出的时候,总是接到市民的投诉,为什么老是占线?为什么回复很慢……上线了言犀之后,热线接通率有了大幅提升,更关键是言犀推荐的答案与市民提问匹配度非常高,交流更顺畅,市民也就更加满意了。

再比如对于母婴品牌Babycare的客服人员李艳来说,言犀的出现让她可以将精力更多倾注在解决用户个性化、专业化问题上。同时,有了智能客服系统辅助,即使是在大促期间,也能让身为宝妈的她早点回家,陪伴自己宝宝成长。

家住在天津河西区翁奶奶,每天早上9点,都会准时接到言犀的电话,用1分钟左右的时间详细地了解翁奶奶的身体健康以及生活情况等。

在养老产业,言犀使用拟人化的智能外呼系统,每天上午对全区独居老人展开自动呼叫,若两次拨打电话无人接听,系统就会立即通知家属或者社区网格员上门,以防范独居老人遇到突发疾病等问题,目前可满足区域内20万老人的养老服务需求。

何晓冬表示,京东智能客服-言犀能够如此强大,不仅是依靠向金牌服务人员学习,更是基于平台本身的海量应用场景训练。

智能人机对话与交互系统代表的是新一代融合性的智能,它是基于“活的”交互场景去迭代和发展,而京东复杂的业务场景每天有数百万的咨询量、消息量达千万级,基于此我们的模型才有机会迅速发展。

而通过和不同的用户不断沟通、测试最佳应答方式,京东的智能客服系统每天可完成百万乃至千万级的迭代量。

在阿兰·图灵博士的时代,图灵实验还只是一个头脑实验,做一次真实的图灵实验都是个奢望,而现在,单在今年11.11一天京东的智能客服系统就跟超过1000万用户进行了交流互动,相当于做了1000万次图灵测试,而每一次测试,都会为AI带来点滴新的进步。

「这是京东在AI技术发展上最大的“护城河”」,何晓冬说。

应用之外,京东AI团队也已在ACL、NeurIPS、AAAI等顶级学术会议上发表了超过130篇论文,在16项世界级AI能力赛事获得冠军。

这也与近年来行业趋势相吻合。

随着AI不断深入和落地,有业务、有场景的公司正在展示出更大的智能未来前景。一方面是对前沿技术的迅速应用,另一方面则是在落地应用和数据迭代中,创造出更强的模型和研究成果。

对于京东这样的平台型公司来说,科研和技术背景出身的科学家,也就适得其所、相得益彰,真正能做到技术在产业落地,让技术真正走入千家万户,潜移默化地为每个人带来更美好的生活。

于是即便向来低调,在时代趋势和浪潮中,有抱负的科学家,也会被越来越推至台前。

趋势已经开始,趋势还会继续。

- 刚刚,“云计算一哥”版龙虾发布,奥特曼打着官司也要云站台2026-04-29

- 河南师傅,左手扳手,右手飞书,竟然能搞数据分析!2026-04-23

- 神秘模型「大象」:仅100B拿下SOTA,Token效率超高!2026-04-22

- 国内首家百亿估值纯推理GPU独角兽诞生!专访曦望联席CEO王湛:谁的推理成本更低谁就是赢家2026-04-23