最牛的NLP都在研究啥?统计400多篇顶会论文发现:统一泛化标准是关键

Meta、剑桥、港科大研究者拿出了“最强工具”来解决

Alex 詹士 发自 凹非寺

量子位 | 公众号 QbitAI

一篇NLP (自然语言处理)研究综述文章火了。

根据paperswithcode统计,此文目前已经获赞超800,转发超200次。

来自Meta AI、亚马逊、剑桥大学和纽约大学等的研究人员,针对NLP目前的最关键任务:泛化——

提出了一种分类评价系统,以解决目前圈内缺乏分类及评判体系的问题。

为此,他们对过去400多篇泛化相关论文进行分析与归类,共进行600多个单独实验,通过回顾过去泛化相关的研究,也对未来提出更多展望。

此外,研究者们还自建了一个网站,便于泛化领域研究者们搜寻同行成果(链接已附在文末)。

目前,此项内容已在arxiv公布并被圈内研究者关注到。

有网友表示以往很难搜寻相关内容,向团队表示致敬:

也有日本相关爱好者关注转发:

所以,这篇综述具体提出了些什么?

创立针对泛化的分类法

说研究成果前,先简述下什么是泛化。

该任务可大致理解为根据过去经验迁移到新任务、问题上的能力,按中学老师的口吻,也就是举一反三的水平。

人们在日常组词造句时其实都有一定的泛化倾向。比如,当你理解了“红”可用于形容苹果,自然就会说“红番茄”、“红草莓”等词,但这对机器却是个难题。

泛化能力还需依靠大量基本常识,否则词汇自由组合难免会出现啼笑皆非的效果。比如“绿色吃小狗”、“量子位大于美女”……

玩笑归玩笑,放NLP领域中,泛化的确一直被视为重点攻坚方向,不少从业者更将该能力视为通往AGI的关键。

但长期以来,对于NLP模型到底应该怎样进行泛化操作,及评估其泛化性能的条件,却鲜有一致的标准和意见,泛化行为一直被简单地用“随机训练-测试分割”来评估。

在本篇文章中,研究者通过回顾过去数十年NLP领域泛化能力的成果,希望用一个系统来定义和讨论泛化问题——

由此,他们提出了一套分类法,设计出五个维度供泛化领域的同行们参考:

(1)motivation 动机

(2)generalisation type 泛化类型

(3)shift type 偏移类型

(4)shift source 偏移源

(5)shift locus 偏移轨迹

还统计了哪些类型研究多,哪些类型相对小众,以图呈现(整得挺像样):

下面来展开说说这些分类维度。

(1)动机 维度

所谓的动机维度,源于根据泛化任务的底层目的来对各种问题进行分类。

比如市面上主流泛化任务,意在提升模型的实用性,希望模型在经过某一类文本数据集训练后,也能在其他场景给出合理回应并具备足够的鲁棒性,其动机在于提升实用性。

但有的泛化研究不聚焦实用场景,而是纯粹就想拔升模型的认知能力,希望它具备更快学习的能力,此前有科学家研究LSTM如何优化嵌套语法结构,也是为该目的服务。

除此之外,动机维度还包括研究模型是否正确理解任务,是否在应用中保证公平和包容性。

下图展示了2018-2022年不同动机泛化研究的占比数量,其中实用性仍为大头:

(2)泛化类型 维度

该维度从泛化任务的类型出发进行分类。

在实际研究中,有的泛化研究聚焦各种信息的重组结合,本文前面提及的「红苹果——>红草莓」就属于此类。

此外还有语句内容结构变化的泛化问题、跨不同任务之间的泛化、跨不同语言的泛化…都属于从类型维度进行分类。

研究者们给出了6个类型的分类,情况如下:

(3)偏移类型 维度

该维度从技术实现过程中分类,根据不同泛化任务中测试集、训练集与预测结果各种变量概率分布的偏移情况,研究者分出3个主要类型:

协变量偏移、标签偏移、全偏移。

这其中,协变量偏移在诸多研究中占比最多,这是由于训练模型过程中,经常难以保证每次输入满足稳定分布,基于泛化任务定义,直观也能想象此类情况发生不会少见。

除却上述三种,研究人员还进一步加入了两种偏移分类,即假设偏移和多重偏移。

(4)偏移源 维度

正如上段提到,泛化研究中变量偏移是普遍情况,研究者们又从造成偏移的源头出发对不同研究进行了分类。

这其中包括了:自然产生偏移、训练模型及调整语料库等过程中人为造成的偏移、使用生成数据造成的偏移等类型。

值得一提的是,不同数据集之间自然产生的变量偏移占比最高。

(5)偏移轨迹 维度

最后,研究者基于变量偏移发生的部位,提出一个新分类维度。

考虑从头到尾整个模型训练调参验证步骤,变量概率分布发生偏移的位置有——

训练到测试过程之间、微调到测试之间、预训练到训练过程之间、预训练到测试过程之间以及整个流程发生多次偏移的情况。

这其中,早期研究论文发生变量偏移集中在训练到测试过程中,但2020年后,更多偏移问题发生在微调到测试过程之间。

为NLP泛化测试统一标准打基础

研究者分析发现,近几年来,和泛化相关的论文数量飙升:

他们先用计算机从ACL(NLP与计算语言学领域顶会)文集中筛选出标题或摘要中包含generalisation、generalization、generalise或generalize等词的论文。(这些词都和“泛化”有关)

并人工检查了被选出来的论文,以去除那些实际上并没有展开讲泛化问题的论文。

然后他们统计出这些论文的数量,以及其在每年的ACL总论文数中的占比。

结果显示,这些论文不论是绝对数量还是相对占比都在大幅提升,而且从2018年起至今尤为明显。

接下来,他们使用了前文介绍的分类法对这些论文进行注释。

对每篇论文而言,第一位注释者给其5个标签,然后第二位注释者将会检查这些标签。

如果这两位注释者之间产生了分歧,他们会先进行讨论来试图解决问题。如果这两位没法达成一致的话,这时第三位注释者就会登场了。

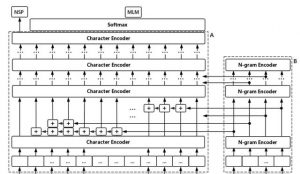

不止上述一个步骤,整个注释过程都相当严谨。(可以看看这张图感受一下…)

经过细致的分类统计工作,结果显示,跨领域的泛化问题是最被关注的,占比超过30%,其次是鲁棒性和任务理解方面。

此外,超过一半的研究都碰到了自然造成的变量偏移问题,这也是相关从业者最关心的。

分类的意义不止于此。研究者通过这种方式提出一个新的框架来系统化和理解泛化研究,最终目的旨在为NLP的泛化测试建立可靠的统一标准奠定基础。

他们相信,他们的系统性分类框架为泛化发展提供了必要基础,为相关研究者提供了更有效的工具,帮助大家能快速找到可参考的相近成果。

在发表本文的同时,这群研究人员还发布了一个网页,并打算及时跟进NLP泛化研究的最新进展。

研究者指出,他们希望通过这些系统化的框架和这个在线工具,来尽可能地统一大伙儿对“NLP泛化测试”的理解,因为现有研究几乎都处于“各抒己见”的状态。

(毕竟这个领域的研究几乎从2018年才活跃起来)

他们认为,关于NLP模型的重要泛化测试应该被托管在一个共享平台上,同时还得有个排行榜,来使其更加方便和透明化。

在一个大型社区上(像GitHub这种),NLP研究人员和领域专家们共同探讨并决定哪些测试应该优先进行。

当然,研究者们也明确表示,目前的工作还没有为泛化测试提供标准化的数据或程序,这些还得一步步来。

研究者来自科技巨头和顶尖大学

这篇综述的作者可谓“群星璀璨”。

除了有来自Meta和亚马逊等科技巨头的研究员,还有来自爱丁堡大学、剑桥大学、NYU和香港科技大学等高校的学者。

论文一作Dieuwke Hupkes现任Meta AI的研究科学家,主要研究方向为用于NLP的人工神经网络。

这些研究者补充道,下一步他们将会分析判定关于NLP的哪些泛化测试将优先进行。

他们指出,如果研究进展得比较顺利的话,甚至在明年,关于NLP的泛化测试标准就会发生重大改变。

论文地址:

https://arxiv.org/abs/2210.03050

网页传送门:

https://genbench.github.io/visualisations

- 谷歌研究回顾2022年健康领域进展:达成多个合作,迈向移动医疗2023-03-03

- 美团创始高管离职创业/ 国内首个类ChatGPT下月开源/ 推特员工睡公司仍被裁 …今日更多新鲜事在此2023-02-27

- 人类离「定居月球」又近一步:贝索斯公司用月壤实现太阳能发电2023-02-24

- 每周只上四天班:半年试验后,老板竟然也喜闻乐见2023-02-23