高通Ziad Asghar:AI处理的重心从云端向边缘侧转移,智能手机是最佳平台 | MEET 2023

终端侧AI需求会越来越多

萧箫 整理自 MEET 2023

量子位 | 公众号 QbitAI

从Stable Diffusion到ChatGPT,这半年AI算法应用可谓突飞猛进。

但对于硬件领域而言,AI计算的下一个突破口或未来趋势究竟是什么?

尤其是AI应用最大的领域之一——移动端,大量AI算法在这里遭遇考验,也在这里部署落地。

作为移动硬件领域对终端侧AI最有话语权的芯片厂商之一,高通对于未来AI计算的发展方向是如何预测的?

在MEET2023智能未来大会上,高通技术公司产品管理高级副总裁Ziad Asghar分享了自己对于提升AI处理性能、以及未来AI计算发展方向的思考:

数据会不断从边缘侧产生,因此AI处理的重心正在持续向边缘转移。

边缘侧是进行AI处理的最佳选择。

为了完整体现Ziad Asghar的分享及思考,在不改变原意的基础上,量子位对他的演讲内容进行了编辑整理。

关于MEET智能未来大会:MEET大会是由量子位主办的智能科技领域顶级商业峰会,致力于探讨前沿科技技术的落地与行业应用。今年共有数十家主流媒体及直播平台报道直播了MEET2023大会,吸引了超过300万行业用户线上参会,全网总曝光量累积超过2000万。

演讲要点

- 数据会不断从边缘侧产生,因此AI处理的重心正在持续向边缘转移。

- 消费者希望有更好的数据隐私,所有的终端数据能够留在终端上,希望数据可靠,处理结果即时获取。因此,边缘侧是进行AI处理的最佳选择,而高通一直在推动这场变革。

- AI处理的最佳平台是智能手机,因为它随时随地可用,且人人都有、人人可用。

- 过去所有的AI推理都在云端进行,如今大量推理工作正在被转移至边缘侧完成。

- 终端侧的实际数据可能让模型的训练效果产生重要变化,同时提升其泛化能力。

- 自动驾驶领域充满挑战,它必须能高精度分辨人类和障碍物,否则后果不堪设想,这也恰好是AI的用武之地。

(以下为Ziad Asghar演讲实录整理)

AI处理下一阶段:边缘计算

今天我将和大家分享的主题是,高通如何让智能网联边缘(Connected Intelligent Edge)成为现实。

这几年来,我们的团队研发了不少前沿AI技术,也一直在不断提升终端侧的智能水平。

在此期间,我们“将很多不可能变成可能”,不仅打造了一些全新的应用案例,增强和改进了现有产品的体验,还通过AI技术提升了终端侧和产品的性能。

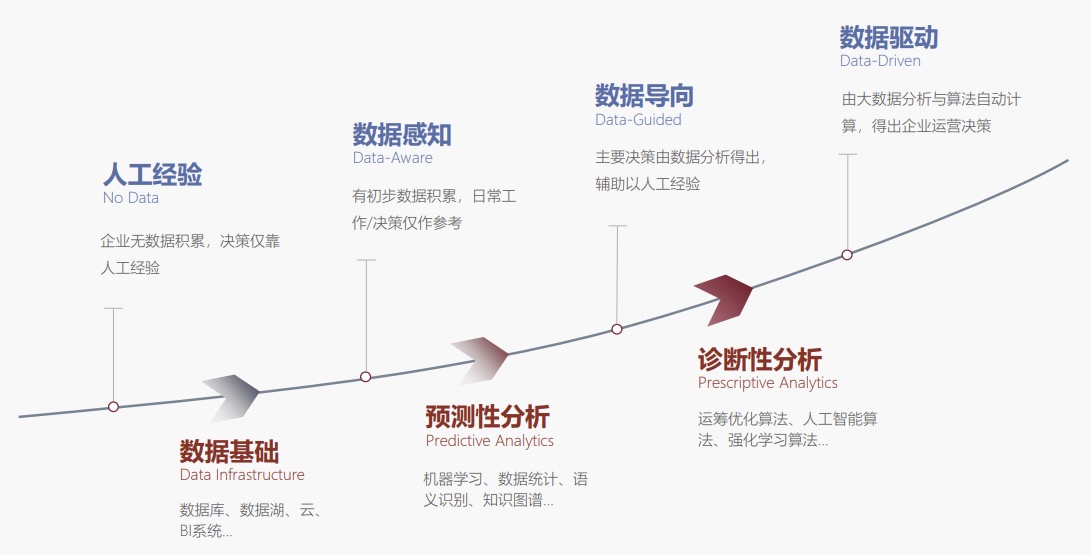

聚焦终端,我们会发现数据不断从边缘侧产生,因此我们认为,AI处理的重心正在持续向边缘转移。

主要有两方面原因:

一方面,消费者希望保护个人数据隐私,即将终端数据保留在终端设备上;另一方面,消费者又需要可靠的数据、并即时获得处理结果。

因此,边缘侧是进行AI处理的最佳选择,而高通一直在推动这场变革。

着眼当下,高通已经在智能手机领域取得了突破性的成果,也将不少AI算法应用到了影像、图形处理等功能中。

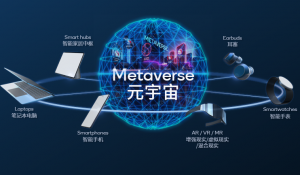

随着我们不断向前发展,这些技术还会被集成到XR眼镜、PC、物联网、汽车等产品当中,而这些产品也会应用更多AI技术,目的是带来更好的体验、突破更多瓶颈。

所以,高通究竟运用了哪些让产品脱颖而出的技术?

首先,高通专注于基于“统一的技术路线图”进行产品开发。

作为能够全面覆盖智能网联边缘、实现规模化扩展的技术,它涵盖了边缘AI、前沿的视觉效果和视觉技术、图形和游戏技术、新颖的多媒体效果、极快处理速度,以及5G连接能力等特性。

我们将这些技术进行规模化扩展,从耳机等较低复杂度的产品,一直延伸到汽车、ADAS系统等高复杂度的产品。

这张图片展示了AI技术的一系列应用场景,当然这还只是终端设备中的一小部分:

至于这些AI技术,则包含了自然语言处理、面部识别等多种不同的能力。

然后就是高通AI引擎了。得益于这一核心成果,目前高通的AI技术已经赋能20亿终端。

高通AI引擎包含图形处理单元、CPU、以及更关键的Hexagon处理器,其中Hexagon处理器又包含标量、向量和张量处理器。

如果从神经网络架构来看,你会发现标量、向量和张量处理器能很好地与神经网络模型的不同部分实现匹配,这正是我们模仿自然界的神经网络模型、从而打造Hexagon处理器的原因。

那么,高通AI引擎具体能做些什么?

根据一些基准测试数据,高通AI引擎表现十分出色,显著超越了同行产品性能。

从第一代骁龙8到第二代骁龙8,我们都非常专注于自然语言处理(NLP)、目标检测等模型的性能优化。

以MobileBERT模型为例。正如图片所展示,针对这个NLP模型,我们将处理速度提升了超过4倍:

我们还会持续优化性能、不断突破模型极限,在边缘侧实现更多能力。

此外,我们还开发了具有高度可扩展性的硬件架构。

高通的移动平台,通常会配置一个Hexagon处理器实例;但如果扩展到计算等其他业务时,也可以使用两个Hexagon处理器实例;面向汽车、云和边缘,则可以使用多个Hexagon处理器实例来提高算力。

但这也需要针对性地面向可扩展性进行开发。而高通已经具备这样的独特算法和架构,让这种技术成为可能。

从性能和能效角度来看(既定功耗下可以释放多少性能),我们已经多方面超越了竞争对手,这是基于过去几年积累的技术不断提升的成果。

例如根据性能基准测试AITuTu,在排名前十的AI平台性能列表中,骁龙平台就占据了前四名,包括第二代骁龙8、以及此前发布的第一代骁龙8、骁龙8+和骁龙888。

△数据来源:AITuTu

这其中甚至还有骁龙7系产品入榜,也是我们技术实力的体现之一。

如今,我们的目标是让AI无处不在——

因此,AI处理的最佳平台应该是智能手机,因为它随时随地可用,而且人人都有、人人能用。

如何提升端侧AI处理性能?

为了让AI在终端侧发挥最大作用,我们带来了哪些技术呢?

其中之一,是支持INT4精度推理。

相比于INT8,INT4能够实现60%的能效提升和90%的AI推理速度提升。如果从INT8转化到INT4、或从浮点计算转化到整数计算,在同样的算力下我们就能够处理更多数据。

如果把32位浮点模型转化为INT4模型,这个能效甚至可以提升到64倍。

这些是我们已经在边缘侧实现的技术。

可以看到,将模型从INT8转化为INT4时,推理精准度和画面质量均没有受到影响。这也得益于我们打造的前沿工具和软件,用它们能够让前沿技术与我们的硬件方案充分结合。

除了持续提升性能、并应用Hexagon处理器引擎以外,在芯片子系统中,我们还集成了一个小型、“始终在线”的引擎,称之为高通传感器中枢。

它能同时处理多路数据流,包括传感器、语音和音频、连接和始终感知的摄像头等,有了它我们就能实现更多应用案例。

实际上,我们将高通传感器中枢的AI能力提高了一倍,通过增加50%的存储,提升它安全方面的性能,包括人身安全、数据安全、健康等等。

举例来说,让它具备识别隐患声音的能力,比如半夜传来的玻璃破碎声,这样就能使用AI赋能的高通传感器中枢进行监测、并采取对应的预警措施。

通过高通传感器中枢,我们还能提升平台包括关键词识别、异常检测、图像分类能力在内的AI能力。从第一代骁龙8到第二代骁龙8,这些性能提升了近九倍。

如今,我们已经有了全面的解决方案,这里就包括业界领先的软件产品,高通AI软件栈。

高通AI软件栈能够实现“模型一次开发,跨所有高通产品线进行扩展”。也就是说,用户只需开发一次模型,就能在所有不同产品中使用它。

这不仅为高通、也为消费者和客户带来了独特体验,让他们真正感受到这项技术带来的便利。

高通AI软件栈支持所有主流框架,包括TensorFlow、PyTorch和ONNX等等,也提供数学库、编译器等全面的工具支持,让客户能够充分利用高通独特AI硬件的优势。

但正如我前面提到的,包括INT4在内的特性和体验,都需要特别的工具能力。因此,我们开发了全新的工具产品,即Qualcomm AI Studio。

如下面这个视频所示,Qualcomm AI Studio可以实现模型全面管理,包括模型创建、运行情况监测,模型分析等,从开发到运行实现全面支持。

这让我们能够充分发挥INT4的能力,给用户带来更好的体验。

下面这张图清晰展示了我们对于模型完整生命周期的规划,它可以被应用到我们所有的业务和产品线,成为高通产品中一种独特的优势。

我们还支持神经网络架构搜索(NAS)等功能和体验,它允许开发者设定某些模型优化目标,比如具体功耗优化、时延或者精准度等,同时我们还与谷歌就Google Vertex AI NAS展开了合作。

这些不同的产品线让我们大幅改善了时延、并显著提升精准度,下图的1.3%就是一个相当显著的精度提升。

OPPO率先与高通基于Vertex AI NAS展开了合作,提升终端AI的体验。

边缘AI下一步往哪走?

接下来的AI发展方向是什么?

过去所有的AI推理都在云端进行。如今,大量推理工作正在被转移至边缘侧终端完成。

下一步,就是实现完全的分布式AI,即转向终端侧学习的工作方式。这一点至关重要,正如我前面提到的,我们已经开始用AI模仿一些自然行为。

现在AI像人类一样具备一定的推理能力,能够区分图片中的皮肤、毛发、织物或布料,接下来我们还会持续提升推理能力,让终端更加智能。

但问题是,我们如今已能做到一定程度的终端侧学习,这能带来什么收益呢?

目前典型的模型训练方式,通常是基于一定数量的数据进行训练。但终端侧的实际测试数据,却可能让模型的训练效果发生重大变化。这就是终端侧学习能保持甚至提升精准度的原因,同时也能提升模型的泛化能力。

这也能让用户的终端体验变得更加个性化,远超当前终端侧所能实现的能力,而这正是我们在努力的方向,高通正在采取不同的方式实现这一点。

我们的研究团队关注了很多不同的研究方向,包括小样本学习、无监督持续学习、联邦学习和低复杂度的终端侧训练,我会对其中的部分研究方向进行介绍。

基于此大家可以看出,我们已经进入了第二阶段,在边缘进行终端侧学习时,需要做到极低的功耗。

以关键词识别为例,利用小样本学习就可以实现大幅提升,甚至在现实情况下,能让AI做到看完某一人的笔迹或者书面文字后,快速进行辨认。

我们也能做到在用户录入数据时进行局部模型适应,凭借非常少量的样本数据和出色的数据标记能力,大幅提升关键词识别的表现。

举例来说,当遇到说话有特定口音的用户时,针对异常值数据检测,借助小样本学习让关键词检测算法的检测率提升30%左右,让这个模型真正做到灵活运用。

我们探索的另一条路径是联邦学习。云端创建的模型被下发到边缘侧终端后,基于一定程度的离线学习,边缘侧终端就可以根据消费者实际情况调整模型。

同时,由于终端侧学习的过程会产生噪声,所以还能将之回传云端并进一步提升模型泛化能力。

举例来说,如果一辆汽车不断在多个不同国家、不同路况行驶,云端模型就可以持续进行适应,假以时日模型经过优化,就能够打造更优秀的自动驾驶汽车模型,这是我们通过打造平台,支持终端侧联邦学习的又一范例。

没错,包括出色的推理、机器学习或者INT4等能力在内,这些技术对于汽车同样大有用武之地。

汽车是一个充满挑战的独特领域,它的系统必须能够分辨人类和障碍物、并做到高精准度,否则后果将是灾难性的,这也恰好是AI技术的体现。

借助出色的5G能力,我们就能以超低时延将数据传输到终端,大幅提升安全性。

另一个AI落地的关键领域是元宇宙。

例如,用AR眼镜与周围世界互动时,要实现双手交互功能,就需要用到AI手势检测技术;同时,AR给平面上放置虚拟物体的功能,也需要将AI应用其中……还有不少地方也都会用到AI。

整体而言,我们非常高兴能够跨所有业务线,凭借业界领先的软硬件结合能力,以及高通AI软件栈和Qualcomm AI Studio,引领市场向着充分利用智能网联边缘的方向发展。

我坚信,目前我们所利用的终端侧AI能力只是冰山一角。

未来,终端侧AI需求还会变得越来越多,我们十分期待能够沿着这个方向继续推进,让智能网联边缘成为现实。

- 首个GPT-4驱动的人形机器人!无需编程+零样本学习,还可根据口头反馈调整行为2023-12-13

- IDC霍锦洁:AI PC将颠覆性变革PC产业2023-12-08

- AI视觉字谜爆火!梦露转180°秒变爱因斯坦,英伟达高级AI科学家:近期最酷的扩散模型2023-12-03

- 苹果大模型最大动作:开源M芯专用ML框架,能跑70亿大模型2023-12-07